-

输电线路的安全运行是确保从发电侧到输电侧整个电网稳定的关键。因为高压输电线路和配电线路是连接发电厂、变电站和用户的纽带。近年来,输电线路上鸟巢、高空悬挂物等异物引起的安全事故频频发生。在电线上缠绕异物可能会导致三相短路以及接地放电。目前常见的输电线路检查方法有人工巡检、无人机巡检和图像形态学[1-3]。

输电线路系统将电力从发电站输送到配电站,用于住宅和工业用途。与架空传输系统相比,地下传输配置环保但非常昂贵。因此,架空电力线更常用于世界范围内的电力传输[4-5],有时会穿越恶劣环境(沙漠、山区、茂密森林和水库等),输电线路安装在垂直固定塔上[6]。

为了高效、可靠地传输高压电力,输电线路需要进行例行检查,以进行早期故障检测和维护。传输设备故障的检测和定位非常重要,因为它有助于电力传输公司最大限度地降低维护成本并防止不必要的停电。在美国,停电半小时会导致大中型工业客户平均损失15 707美元,中断8小时损失近94000美元[7]。除此之外,不断增长的全球人口和对电力供应的过度依赖都需要提供有效的策略来检查输电线路[8-10]。

传统的巡检方式是熟练的巡线员沿着输电线路手动攀爬,以检测故障或执行日常维护。世界上大部分地区沿线爬行检查是最常见的方法[11]。然而,巡线员的生命可能处于危险之中,因为他们可能会从线路上掉下来或是触电身亡。另一种技术是使用地面望远镜检查线路,尽管在地面徒步巡逻保证了人类操作员的安全,但它非常繁琐、缓慢且效率极低,因为它可能无法提供清晰的线路可视化[12]。

此外,在卡车上使用空中吊篮和机械臂的地面检查也适用于输电线路检查。典型的地面机器人是广达服务公司开发的LineMaster机械臂,其使用安装的液压执行器,可以由地面巡线员或空中篮内的巡线员远程控制臂[13-14]。这种方法的优点是对输电线路进行精确的检查、维护和升级时,不用中断对用户的供电。然而,这种技术缓慢且危险。此外,由于卡车的尺寸较大,可能会影响车辆的运动,将手臂部署到山区或跨越大型水体将具有挑战性[15]。使用配备有望远镜的机载操作员的直升机对线路进行目视检查,该技术比其他方法更快;但使用直升机需要熟练的人员(如飞行员)、加油和直升机本身的定期维护,这使得它成为一种昂贵的检查方法[16]。

随着无人机和机载传感器技术的发展,可实现多传感器协同,提高设备缺陷判断的准确性和自动化程度。通过无人机配备红外、紫外、摄像头等设备,可以及时定位和发现处于萌芽状态的隐患,排除故障,保障输电线路的安全运行。之后还可通过搭载专用设备,对故障点进行细节信息采集,为后续的维护决策做准备[17]。

文献[18]研制了一种高负载、高清、广角摄像头的输电线路巡检无人直升机。文献[19]提出全面实现“机巡为主、人工巡检为辅”的协同巡检模式,推进输电线路“机巡、人工巡检”智能化巡检模式。

目前,深度学习算法可以分为两类。一类是两阶段检测算法,算法分为两个阶段,首先生成候选区域,然后对区域建议进行修正和分类。该类算法的典型代表是基于候选区域的R-CNN算法。另一类是单阶段检测算法,算法不需要生成候选区域,其典型代表是基于回归的YOLO算法。直接实现端到端的物体检测。为了应对实际应用中检测算法需要快速反应的需求,研究人员选择YOLOv5为基础算法。文献[20]提出了基于YOLOv4-tiny的鸟巢定位识别方法,该算法的精度可以达到77.20%;文献[21]提出了一种基于物联网的变电站视觉检测方法,利用传感器融合技术和视觉识别技术实现了变电站的自动检测功能,检测效率提高到85%;文献[22]提出了基于深度学习的鸟巢检测方法,采用新的硬样本挖掘算法来提高模型对小物体的检测能力,引入焦点损失函数,并增加ROI挖掘模块来解决类不平衡问题,检测精度达到82.51%。然而,YOLOv5自身对于被遮挡的目标以及小目标检测仍有不稳定性。所以,本文提出将注意力模型集成到YOLOv5网络的输电线路隐患检测算法,给网络提供目标的全局信息,从复杂的图像中获取语义信息,提高算法检测精度。

本文的主要贡献有:

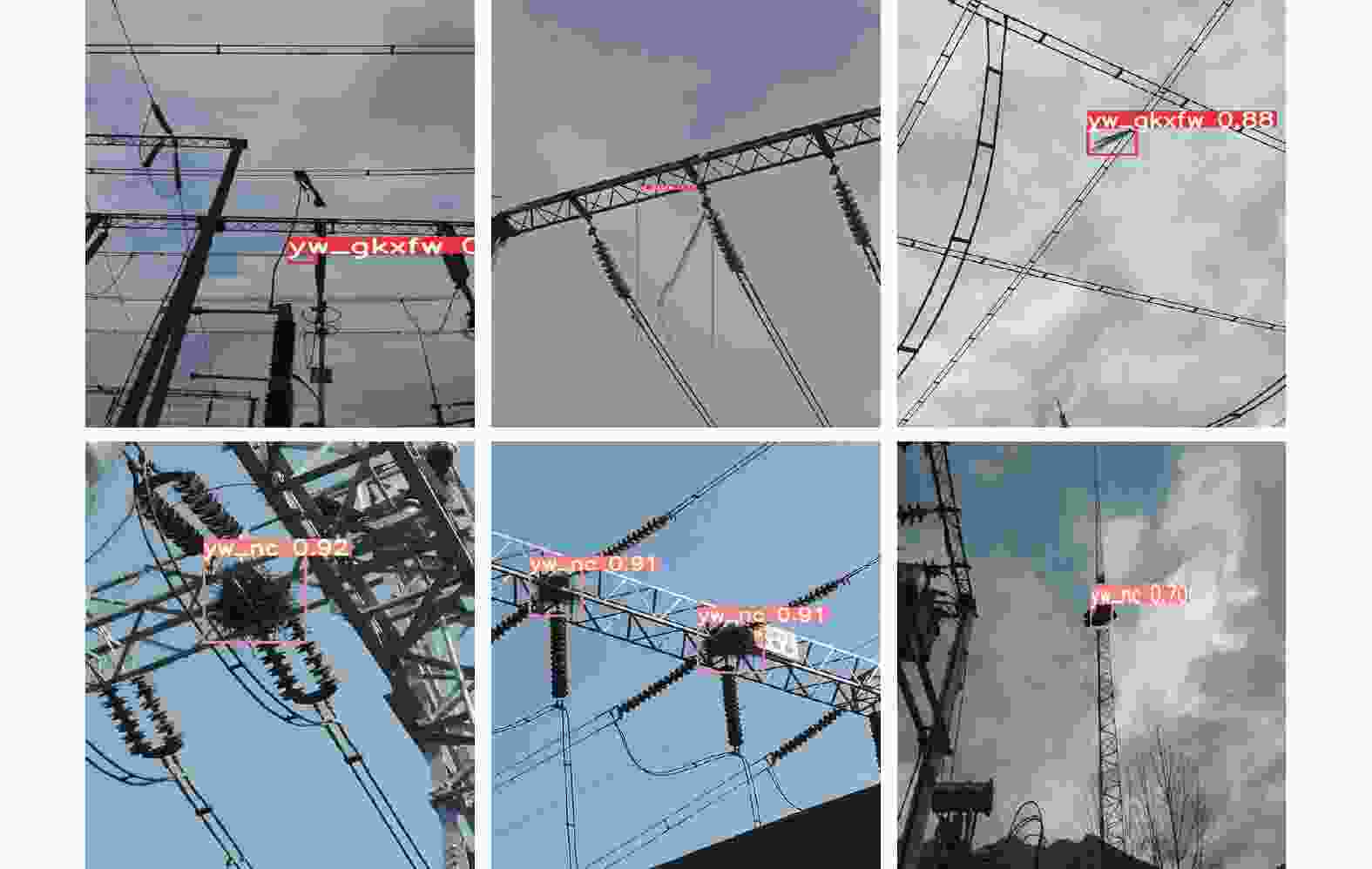

1) 从真实变电站中采集4 000张鸟巢和高空悬挂物的数据集。该数据集场景丰富,应用价值高,使得训练后的模型具有很强的鲁棒性。

2) SE注意力机制被整合到YOLOv5中,细化通道维度中特征图的重要性。实验结果表明,算法精度提高了2%。

-

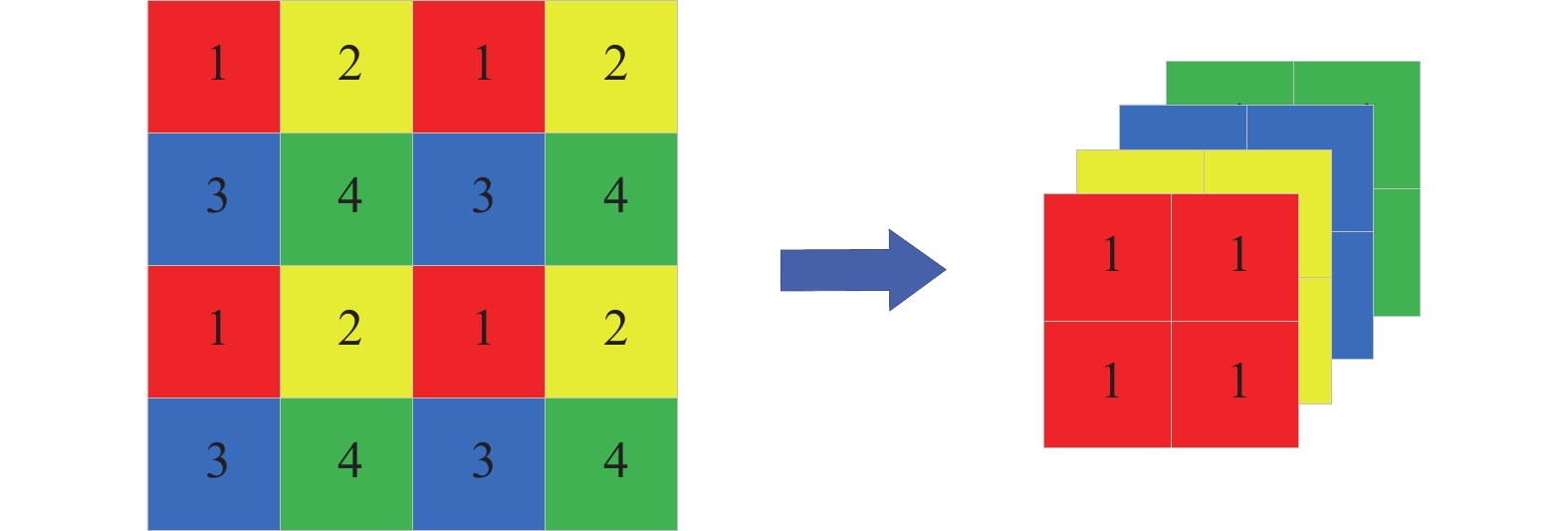

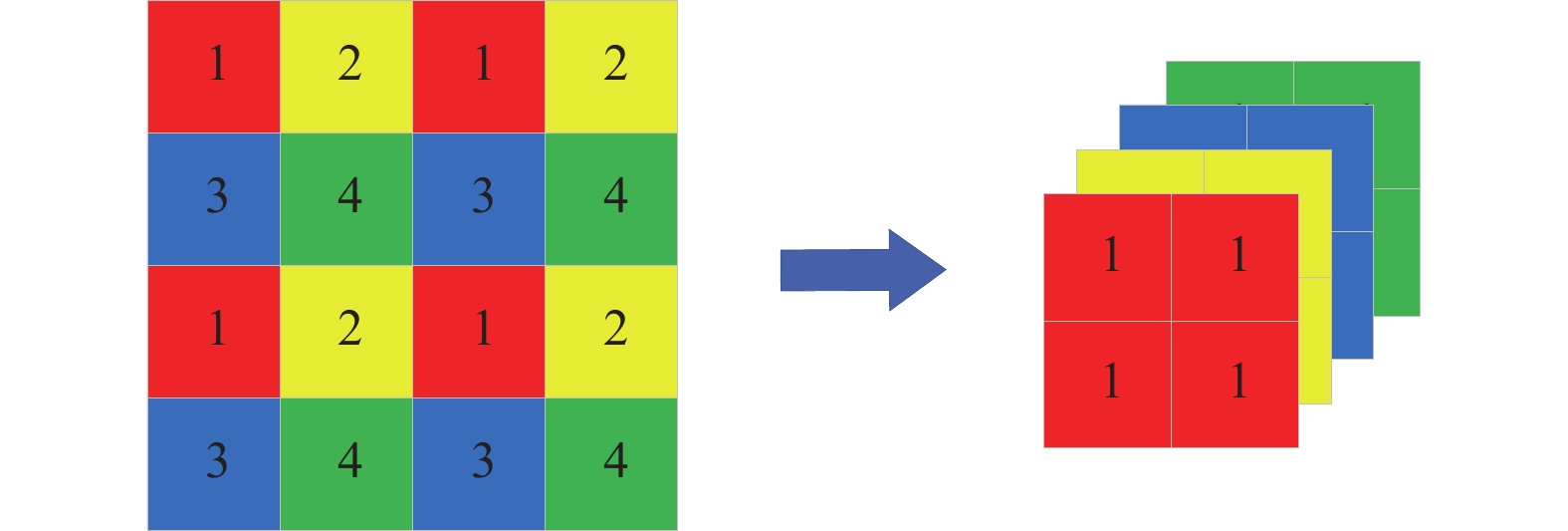

首先将

$608 \times 608 \times 3$ 的图像通过切片操作建立$304 \times 304 \times 12$ 的特征映射,再经过32个卷积核的卷积操作,构建$304 \times 304 \times 32$ 的特征映射。然后,经过CSP模块获得更多的细粒度特征。最后经过注意力模块完成整个特征提取部分。 -

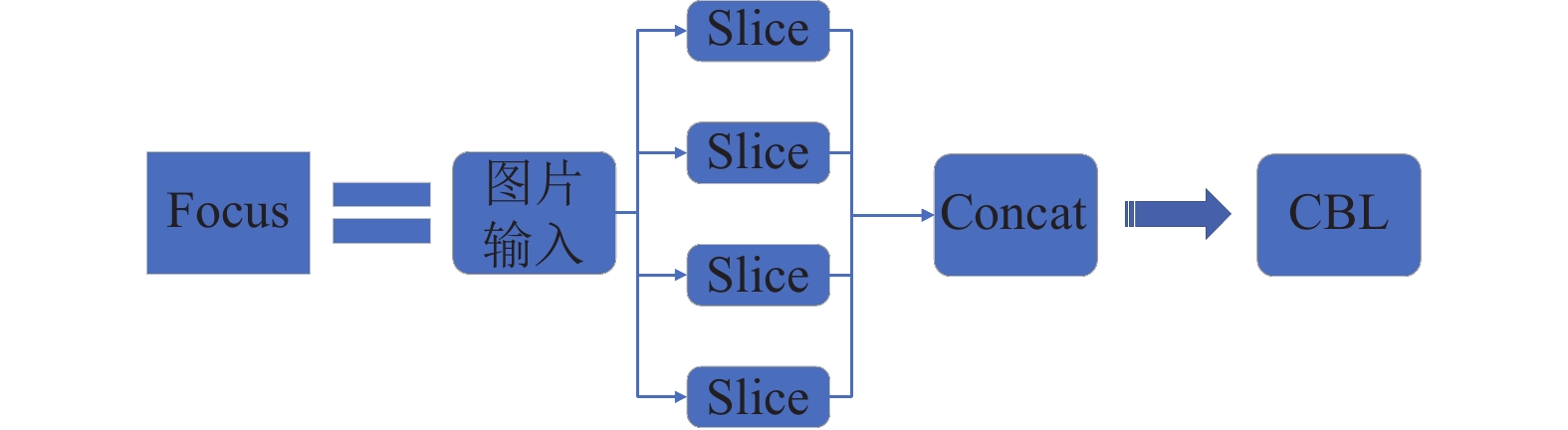

本文设计使用Focus模块对图片进行处理,减少图片特征信息的丢失。整体操作类似于邻近下采样的过程,通过切片操作得到4张图片,4张图片互补,使图片特征信息不丢失,将输入通道扩充了原来的4倍,相对于原先的RGB三通道模式变成了12个通道,再将图片整合成一个新图片,最后通过卷积操作以及激活函数映射,得到二倍下采样特征图[23],在一定程度上保证了不丢失图片特征信息。切片操作如图1所示。

Focus模块其实也是对图片进行一个下采样的过程,但是计算量和参数量是普通下采样的4倍,为算法的准确度和后续的特征提取提供了支撑。Focus结构如图2所示。

-

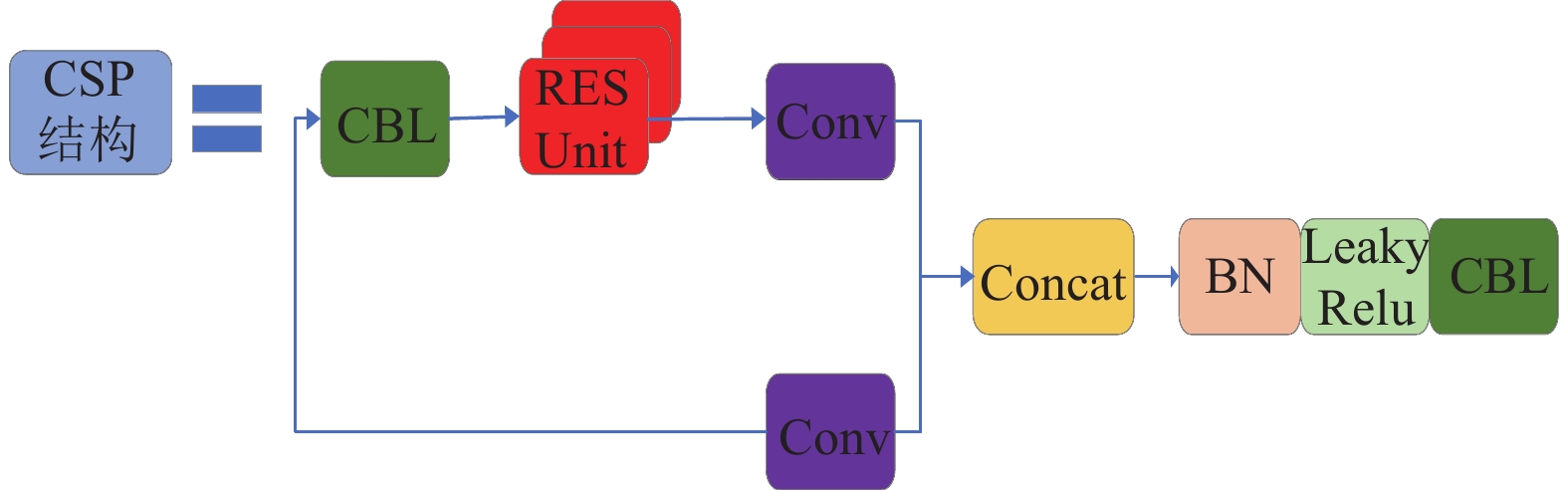

借鉴CSPNet的设计思路,本文设计了一类含有残差模块的CSP(cross stage partial network)模块,应用于主干网络中。CSP网络结构如图3所示。

由于主干网络是一个相对较深的网络,添加残差模块不仅可避免梯度的消失,且能提取更多的细粒度特征。CSP模块在主干网络中应用了5次,其卷积核大小和步长都相对固定,这样可以很好地起到一个下采样的作用。

因为主干网络是一个比较深的网络,CSP结构的作用是增加层与层之间反向传播的梯度值,在减少计算量的同时保证算法的准确率。

-

人类视觉通过利用大脑的视觉信号处理机制,快速扫描全局图像,从而获得需要聚焦的目标区域。然后对该区域进行全面分析,得到所需要的信息。这种机制极大地提高了人类对外物的认知程度和学习能力。因此,本文在算法中引入注意力模块,提高检测的准确率。

目前的注意力机制可以归纳为以下3类。1)通道注意力机制。这种注意力机制获得一种通道权重并且对其进行评分。2)空间注意力机制。这种注意力机制获得一种二维的空间权重再对其评分。3)混合域注意力机制。这种注意力机制将以上两种权重融合[24]。

在传统的卷积网络中,卷积网络的默认特征映射的每个信道权重是相等的。在隐患检测问题中,由于干扰不同,不同通道的比例也不相等。

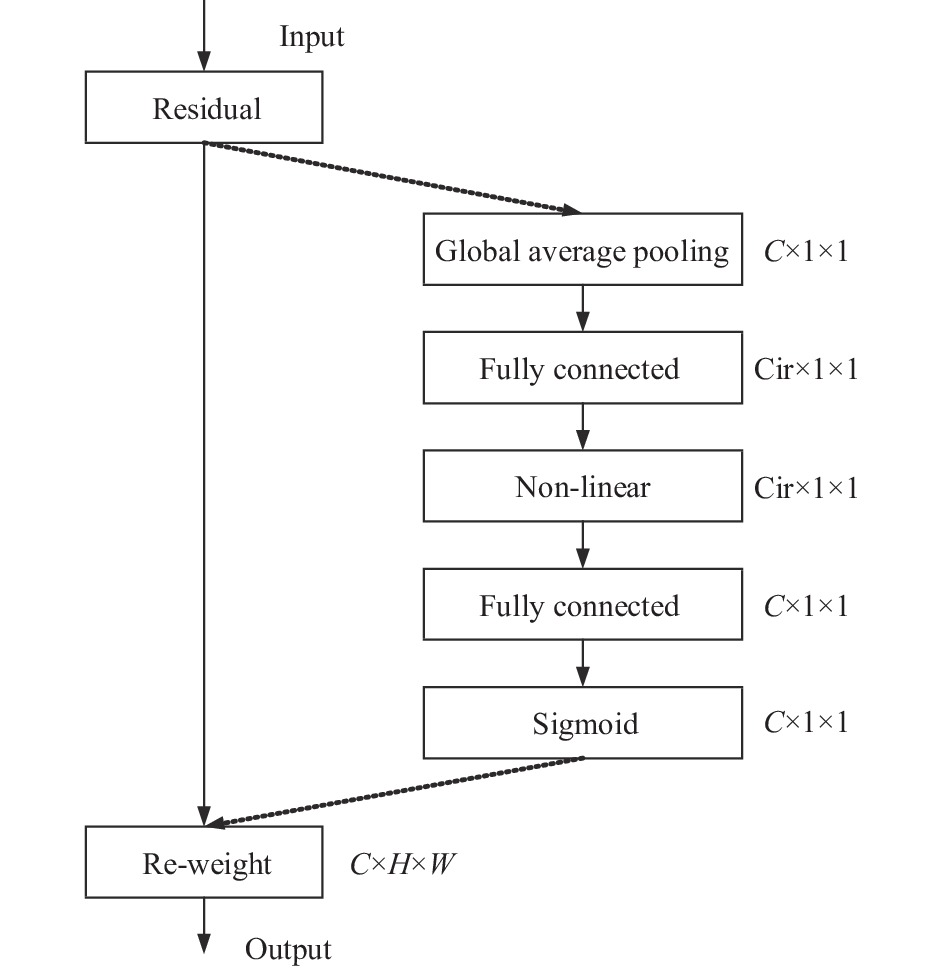

本文在算法中引入了SE注意力机制模块,解决了不同信道比例不同的问题,减少了干扰的影响[25]。SE注意力机制网络结构如图4所示。

首先通过全局平均池化(Global avg pool)对特征张量进行处理,将输入特征中的H和W,输出成大小为

$C \times 1 \times 1$ 的特征。将从CSP结构中得到的${{\boldsymbol{u}}_c}$ ,在空间上对其进行Global average pooling操作,从而得到channel级的全局特征,该操作公式为:$$ {{{z}}_c} = {F_{{\rm{sq}}}}({u_c}) = \frac{1}{{H \times W}}\sum\limits_{i = 1}^H {\sum\limits_{j = 1}^W {{{\boldsymbol{u}}_c}(i,j)} } $$ (1) 然后将

$z_c $ 进行激励操作,该操作由两个全连接层(Fully connected)和两个激活函数($\delta $ )组成。第一个是含有SERadio(r)缩放参数的全连接层,其拥有$C \times {\rm{SERatio}}$ 个神经元,从而达到减少通道个数降低计算量的目的,经过激活函数(Non-linear)的映射后进入下一个全连接层。第二个是含有C个神经元的全连接层,得到$C \times 1 \times 1$ 的输出,最后经过激活函数(Sigmoid)的映射,得到一个比较全面的通道级别的全局描述(z)。该操作公式为:$$ {{s=F}}_{\text{ex}}(z,W)=\sigma (\text{g}(z,W))=\sigma ({W}_{2}\delta ({W}_{1}z)) $$ (2) 得到

$C \times 1 \times 1$ 向量之后,进入Re-weight,将SE注意力模块计算出来的权重分别与原特征图对应的二维矩阵相乘。操作公式为:$$ \boldsymbol{X}={{F}}_{\text{scale}}({{\boldsymbol{u}}}_{c},{{\boldsymbol{S}}}_{c})={{\boldsymbol{S}}}_{c}\ast {{\boldsymbol{U}}}_{c} $$ (3) -

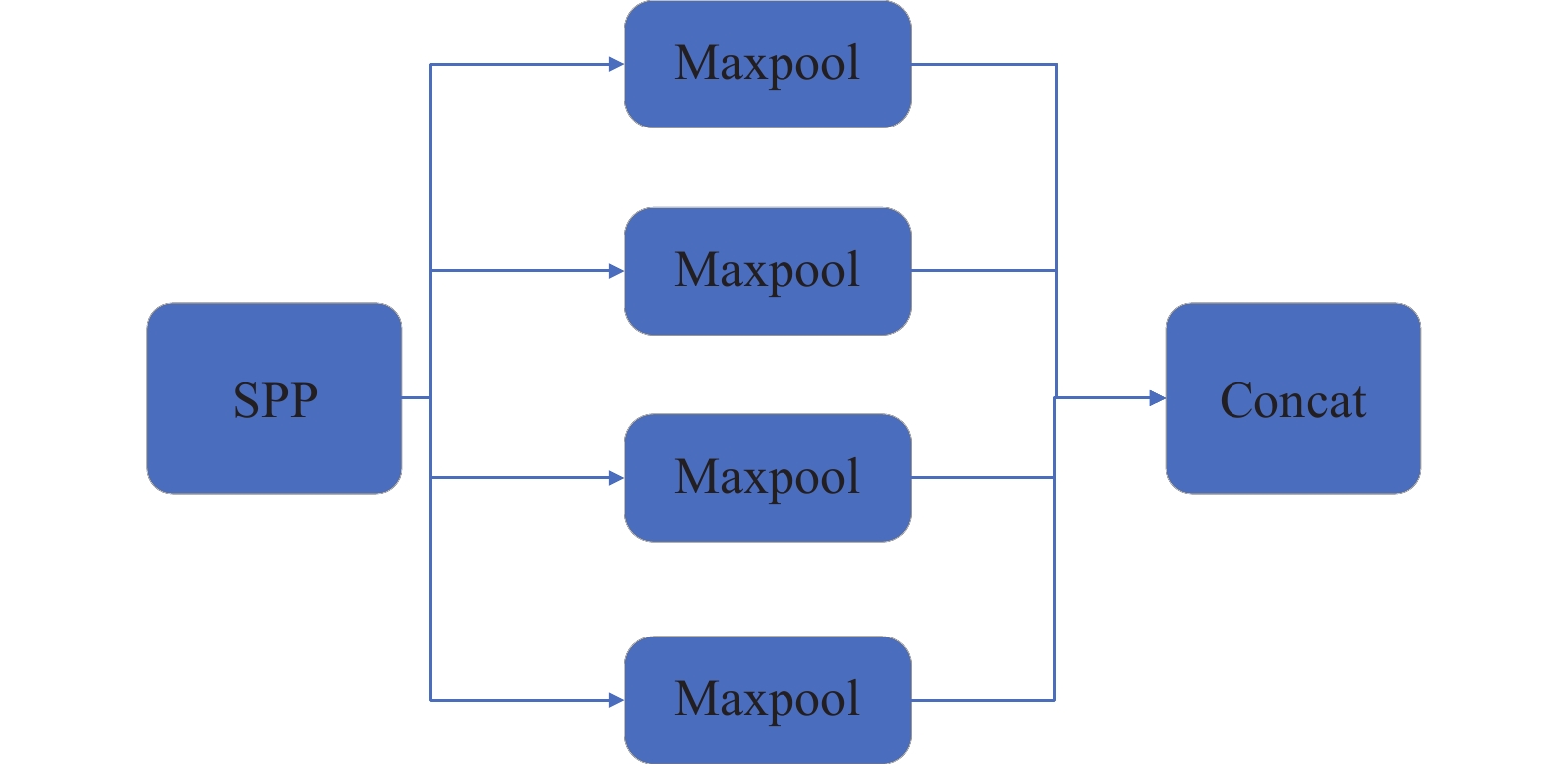

本文在Neck网络主要设计了两个模块,一个是SPP(spatial pyramid pooling layer)模块,另一个是FPN(feature pyramid network)+PAN(path aggregation network)的组合结构。

-

首先使用最大池化的方式,Maxpool大小分别为

${{k}} = \{ 1 \times 1,5 \times 5,9 \times 9,13 \times 13\} $ ,再将不同尺度的特征图进行Concat操作。SPP模块最大的作用是可以得到统一大小的输出,解决输入图像尺寸不统一的问题。SPP模块的结构如图5所示。SPP模块使用固定分块的池化操作,满足模块需要固定尺寸的输入图像的要求,使得算法在检测目标中存在大小差异较大的情况下,依然能获得一个较好的检测精度。

-

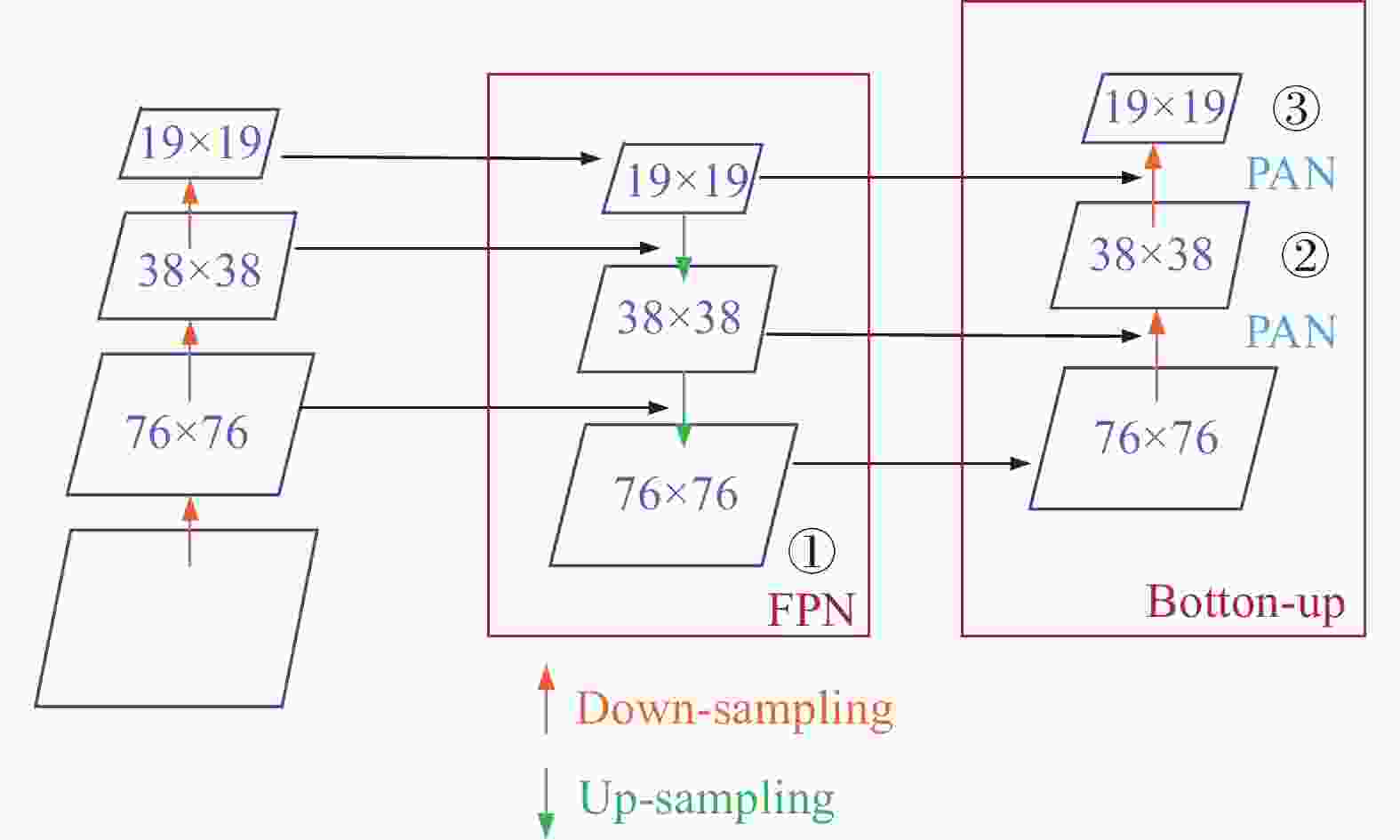

一般来说,浅层特征地图具有较强的位置信息,但语义特征较弱,而深层特征地图具有较强的语义特征,但位置信息较弱。FPN[26]是一种自顶向下的结构,目的是通过上采样融合高级特征和低级特征,然后在多个尺度上进行预测。PAN[27]基于FPN添加了一个自底向上的特征金字塔[28]。FPN层从上到下传递强语义特征,特征金字塔从下到上传递强位置特征。因此,PAN既具有很强的语义特征,又具有很强的位置特征。

在Neck网络中,本文设计了FPN+PAN的组合结构。通过FPN+PAN结构,可以从不同的主干层对不同的检测层进行特征聚合。FPN+PAN采样方式如图6所示。

-

本文算法的损失函数总共有3部分:1)分类损失;2)置信度损失;3)定位损失。考虑到类别相互排斥的情况,采用二元交叉熵损失函数。置信度损失与分类损失相同,一样使用了二元交叉熵损失函数[29]。二元分类交叉熵损失函数为:

$$ L = - \{ y\log \bar Y + (1 - y)\log (1 - \bar Y)\} $$ (4) IoU是目标框和预测框的交点,是与地面真值框和预测框的并集相比。但IoU有以下两个缺点:1)当目标框和预测框没有交点时,IoU=0。IoU=0根本不能反映两个框的可信度;2)相等的IoU并不意味着可信度相同。由于这两个缺点,因此本算法选择CIoU[30]损失函数,其中添加了一个影响因子,不仅考虑到预测框和目标框的长宽比,还考虑中心点距离以及考虑边界框宽高比的尺度信息[31]。完整的CIoU损失函数为:

$$ {\rm{CIoU}} = 1 - ({\rm{IoU}} - \frac{{{\rho ^2}(b,{b^{gt}})}}{{{c^2}}} - \frac{{{v^2}}}{{(1 - {\rm{IoU}}) + v}}) $$ (5) 式中,v是衡量长宽比一致性的参数,表达式为:

$$ v = \frac{4}{{{{\text{π}}^2}}}{(\arctan \frac{{{w^{gt}}}}{{{h^{gt}}}} - \arctan \frac{{{w^p}}}{{{h^p}}})^2} $$ (6) -

采用电力企业内部数据集作为实验支撑。

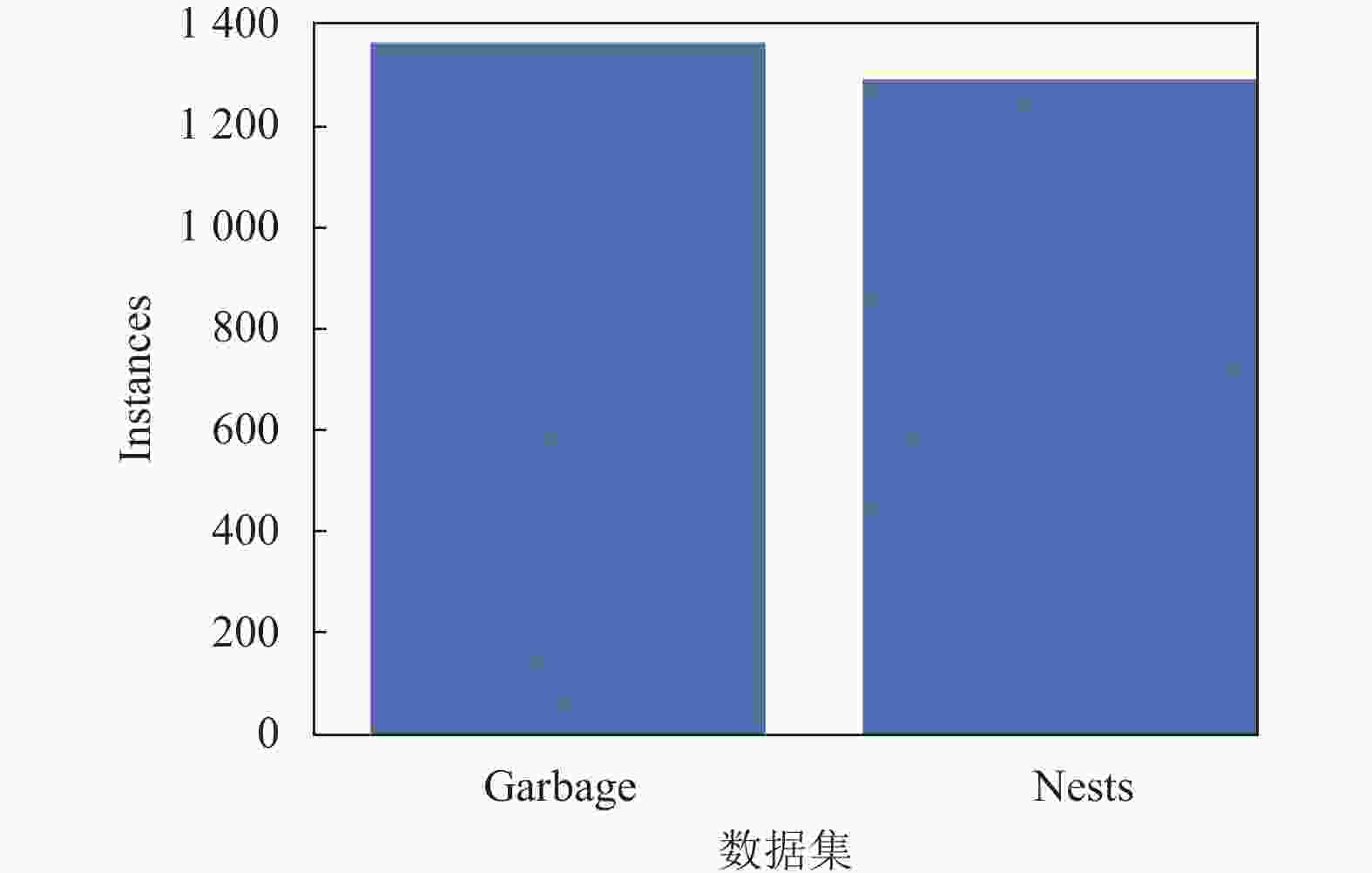

Labelimg作为标注工具,对数据集进行人工标注。将数据集按照0.8的比例分为训练集和测试集。数据集(训练集)分布如图7所示。

在进行数据训练之前,首先会对数据进行Mosaic数据增强,对增强数据进行可视化,使算法对小目标的检测能力大大提高。

实验环境配置:GPU为GeForce RTX 3080,内存64 GB,CUDA为11.1版,python为3.7版,实验采用Pytorch学习框架。

-

本实验采用平均精度(mAP)进行评价。mAP是每个AP类别的平均值。首先,对于每个不同的召回值(包括0和1),实验选择大于或等于这些召回值的最大精度值,然后计算PR曲线下的面积,其面积就是AP值。因此,首先计算准确率和召回率。计算公式分别为:

$$ {\rm{Precision}} = \frac{{{\rm{TP}}}}{{{\rm{TP}} + {\rm{FP}}}} $$ (7) $$ {{\rm{Recall}}} = \frac{{{\rm{TP}}}}{{{\rm{TP}} + {\rm{FN}}}} $$ (8) $$ {\rm{mAP}} = \frac{{\displaystyle\sum\limits_{i = 1}^N {{\rm{A}}{{\rm{P}}_i}} }}{N} $$ (9) 式中,TP的含义是模型预测为正值的正样本;FP的含义是模型预测为负值的正样本;FN的含义是模型预测为负值的负样本。

-

网络模型训练阶段,迭代批量大小设置为32,总迭代次数为300次。初始学习率设置为0.001,采用小批量梯度下降法,并使用Adam优化器计算每个参数的自适应学习率。

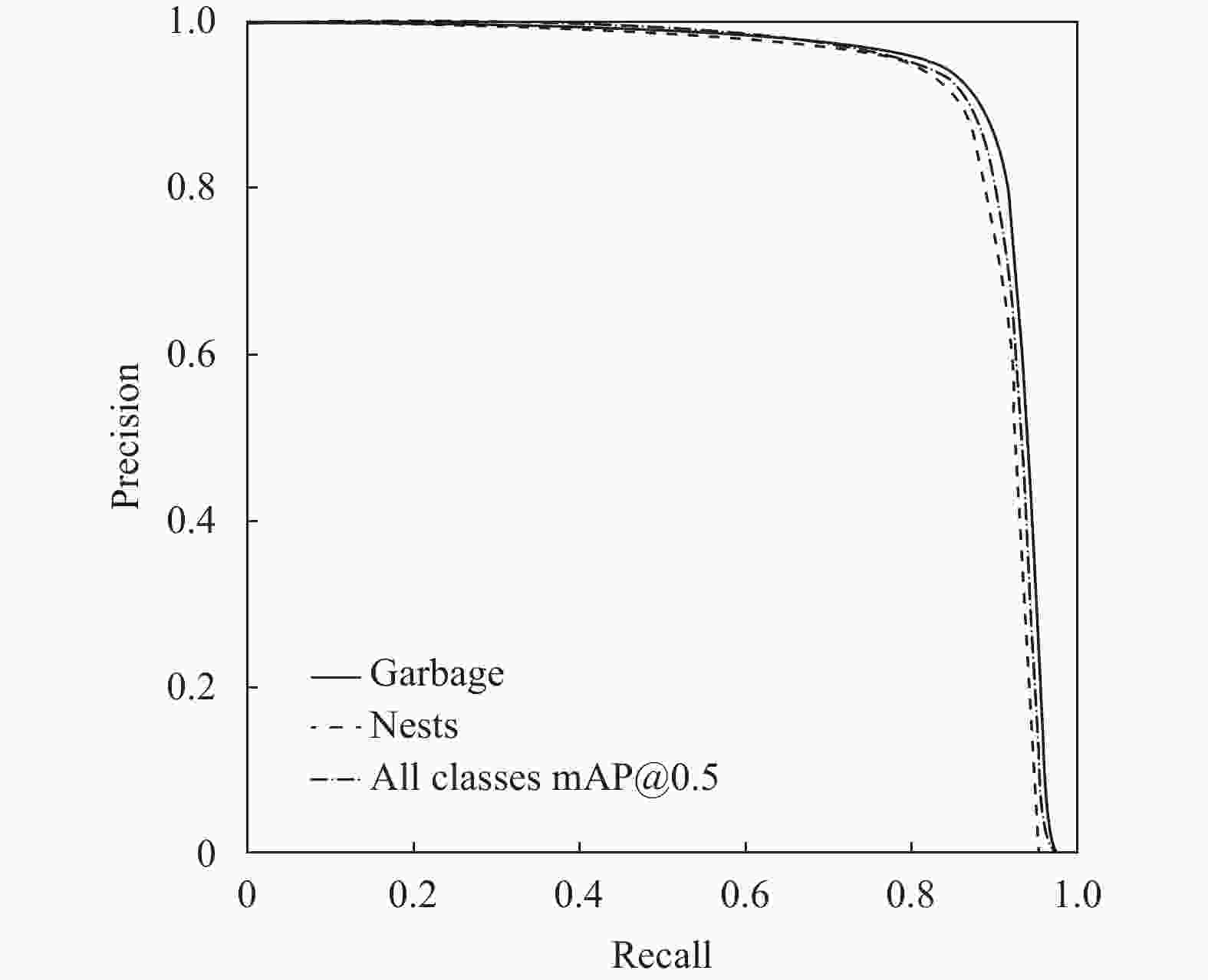

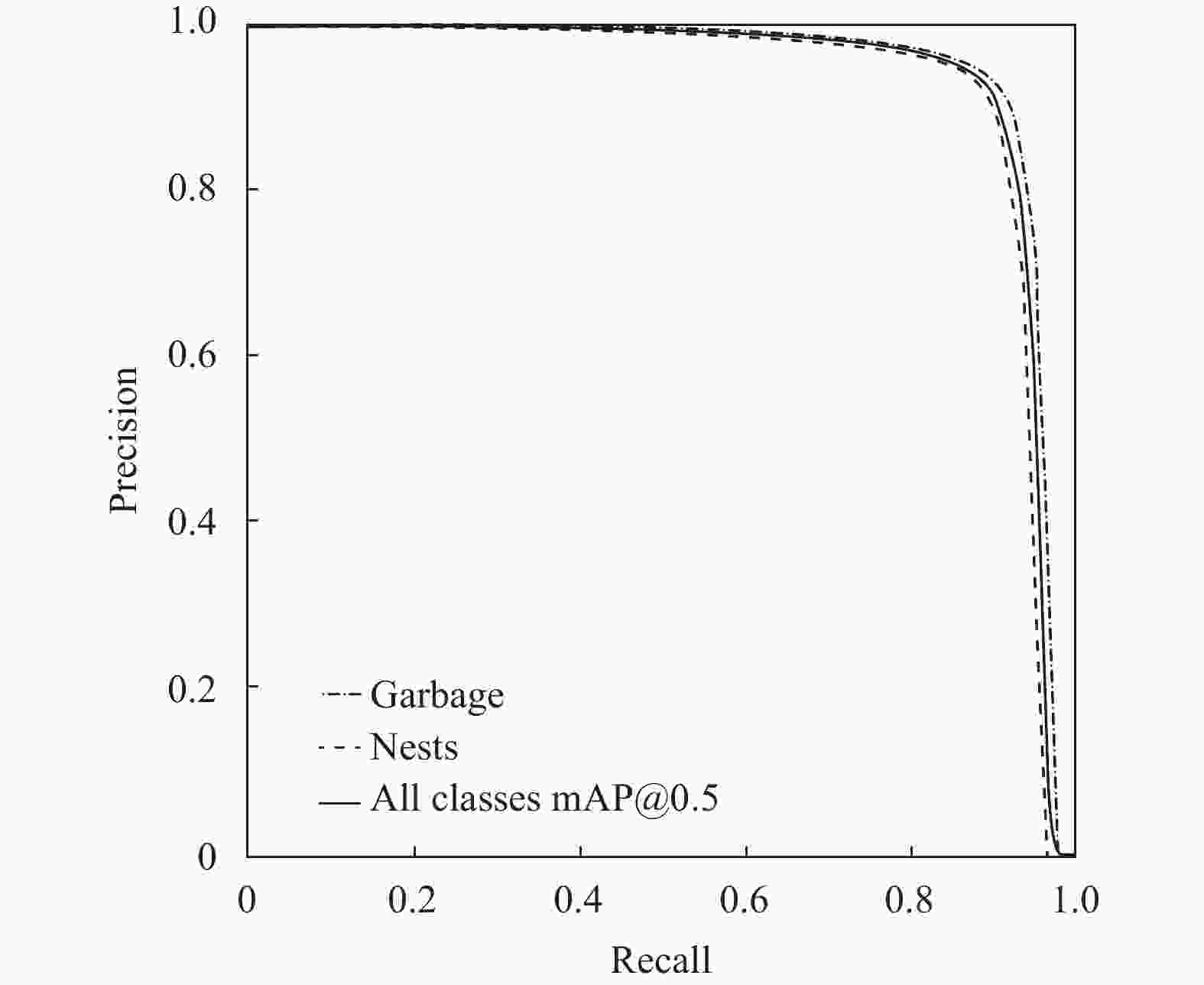

训练结束后,网络会自动生成用于检测高空悬挂物和鸟巢的PR曲线。PR曲线横轴和纵轴所包围的区域表示算法检测的mAP。YOLOv5训练的PR曲线如图8所示。

YOLOv5网络训练得到的高空悬挂物和鸟巢的具体mAP值如表1所示。

表 1 YOLOv5算法的mAP

检测目标 mAP/% Garbage

Nests

All classes82.3

85.3

83.8由表1的数据可以看出,当IoU为0.5时,改进的YOLOv5算法检测到的高空悬挂物的mAP可以达到82.3%,鸟巢的mAP可以达到85.3%,所有类别的平均mAP可以达到83.8%。

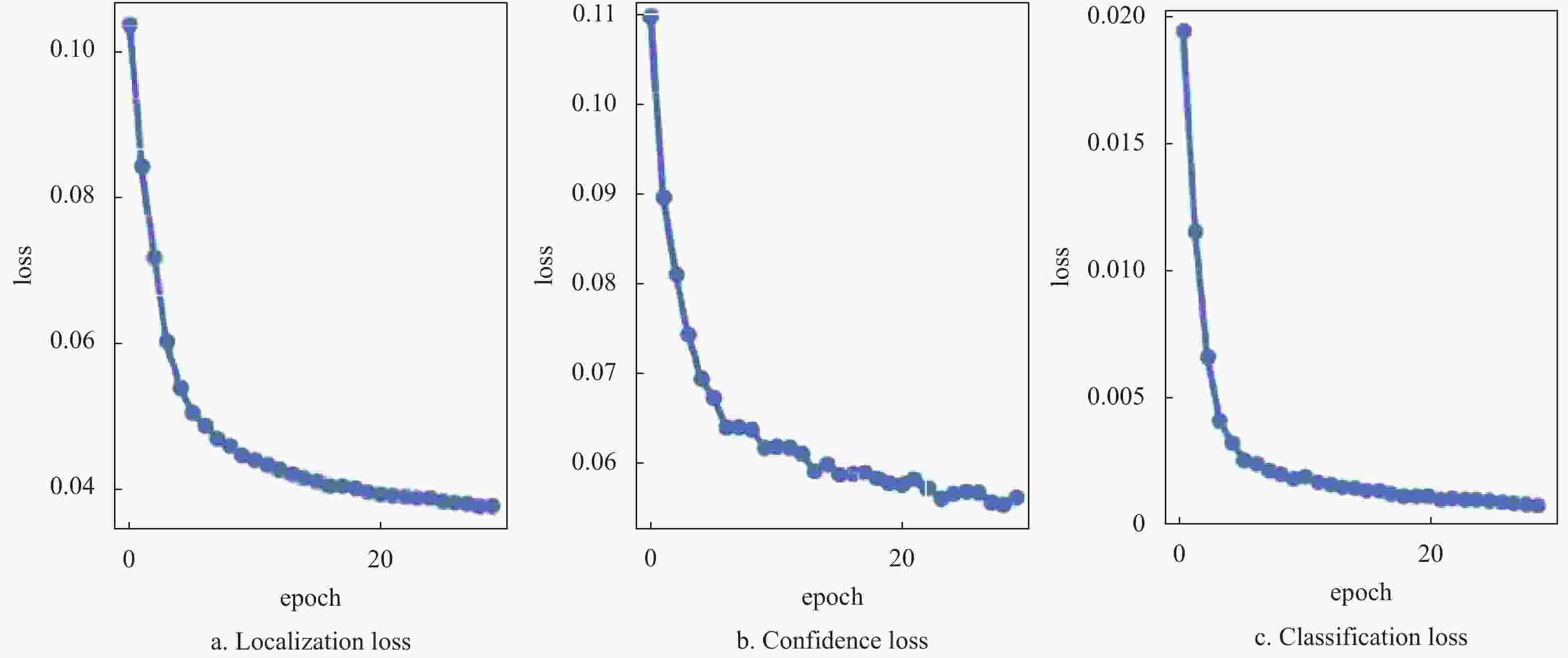

在本文改进的网络中,注意力机制模块放在残差块后,也就是主干网络的最后一层。从实验可得损耗如图9所示。

一般来说,在模型的训练过程中,损失函数的值越小,模型越好,期望值为0。从图9可以看出,横轴表示迭代时间,纵轴表示损失值。随着迭代次数的增加,定位损失、置信度损失和分类损失基本接近于0。检测效果如图10所示。

其他参数不变的前提下,使用改进的网络训练得到的PR曲线如图11所示。

含有注意力机制的改进YOLOv5网络训练得到的高空悬挂物和鸟巢的具体mAP值如表2所示。

从表2中的数据可以看出,当IoU为0.5时,含有注意力机制的改进网络中,高空悬挂物的mAP可以达到84.2%,鸟巢的mAP可以达到87.4%,所有类别的平均mAP可以达到85.8%。对比表1和表2,无论是检测高空悬挂物还是鸟巢,使用含有注意力机制的改进算法网络检测的mAP比直接使用YOLOv5算法高2%~2.5%。数据表明,SE注意力机制给算法带来的全局信息的嵌入和适应性通道关系的加权对精度有明显的提升,同时,也避免了YOLOv5算法对于被遮挡的目标检测不准确的问题。

表 2 改进网络算法的mAP

检测目标 mAP/% Garbage

Nests

All classes84.2

87.4

85.8 -

本文提出了一种基于注意力模块的输电线路隐患检测算法,且详细比较了YOLOv5算法和含有注意力机制的算法。结果表明,含有注意力机制的改进算法网络比直接使用YOLOv5算法检测高空悬挂物和鸟巢的mAP高2%~2.5%。基本满足日常输电线路巡检中的精度要求,推动缺陷检测的智能化发展,解决“巡检难,巡检贵”的问题。

本文研究工作还得到了无人机载双视场AI识别自主巡检系统研发项目的资助,在此表示感谢。

Transmission Line Hidden Danger Detection Based on Attention Model

-

摘要: 为了提高输电线路巡检效率,解决高空悬挂物和鸟巢检测准确率低的问题,提出将注意力模型集成到YOLOv5网络的输电线路隐患检测算法。该算法将SE注意力模型融入YOLOv5网络当中,得到通道级别的全局特征,增强模型对通道特征的敏感性,提高了对高空悬挂物和鸟巢检测的准确率。在一组输电线路隐患图像上进行广泛实验,结果表明,带有注意力模型的YOLOv5网络对高空悬挂物检测的平均准确率为84.2%,对鸟巢的平均准确率为87.4%,该方法检测到的mAP值比直接使用YOLOv5算法高2%。Abstract: In order to improve the efficiency of transmission line inspection and solve the problem of low accuracy of overhead hanging objects and bird nests detection, a transmission line hidden danger detection algorithm integrating SE attention model into YOLOv5 network is proposed to obtain channel-level global features, improve the sensitivity of the model to channel features, and increase the accuracy of overhead overhang and bird's nest detection. Extensive experiments were conducted on a set of transmission line hazard images, and the results show that the YOLOv5 network with the attention model has an average accuracy of 84.2% for overhead overhangs and 87.4% for bird nests, and the mAP value detected by the proposed method is 2% higher than that directly using the YOLOv5 algorithm.

-

Key words:

- attention model /

- hidden danger detection /

- loss function /

- transmission lines /

- YOLOv5

-

表 1 YOLOv5算法的mAP

检测目标 mAP/% Garbage

Nests

All classes82.3

85.3

83.8表 2 改进网络算法的mAP

检测目标 mAP/% Garbage

Nests

All classes84.2

87.4

85.8 -

[1] WANG J J, WANG J J, SHAO J W, et al. Image recognition of icing thickness on power transmission lines based on a least squares Hough transform[J]. Energies, 2017, 10(4): 415. doi: 10.3390/en10040415 [2] BAKER L, MILLS S, LANGLOTZ T, et al. Power line detection using Hough transform and line tracing techniques[C]//2016 International Conference on Image and Vision Computing. [S.l.]: IEEE, 2016: 1-6. [3] 李晓清, 李志博, 路瑶, 等. 基于移动跨越架的输电线路运行故障快速排除技术[J]. 电子设计工程, 2021, 29(24): 116-119. LI X Q, LI Z B, LU Y, et al. Fast troubleshooting technology for transmission line operation faults based on mobile cross-rack[J]. Electronic Design Engineering. 2021, 29(24): 116-119. [4] JALIL B, LEONE G R, MARTINELLI M, et al. Fault detection in power equipment via an unmanned aerial system using multi modal data[J]. Sensors, 2019, 19(13): 3014. doi: 10.3390/s19133014 [5] MENENDEZ O, CHEEIN F A A, PEREZ M, et al. Robotics in power systems: Enabling a more reliable and safe grid[J]. IEEE Industrial Electronics Magazine, 2017, 11(2): 22-34. doi: 10.1109/MIE.2017.2686458 [6] DISYADEJ T, PROMJAN J, MUNEESAWANG P, et al. Application in O&M practices of overhead power line robotics[C]//2019 IEEE PES GTD Grand International Conference and Exposition Asia (GTD Asia). [S.l.]: IEEE, 2019: 347-351. [7] JENSSEN R, ROVERSO D. Automatic autonomous vision-based power line inspection: A review of current status and the potential role of deep learning[J]. International Journal of Electrical Power & Energy Systems, 2018, 99: 107-120. [8] WALE P B. Maintenance of transmission line by using robot[C]//2016 International Conference on Automatic Control and Dynamic Optimization Techniques (ICACDOT). [S.l.]: IEEE, 2016: 538-542. [9] XIE X W, LIU Z J, XU C J, et al. A multiple sensors platform method for power line inspection based on a large unmanned helicopter[J]. Sensors, 2017, 17(6): 1222. doi: 10.3390/s17061222 [10] ALHASSAN A B, ZHANG X D, SHEN H M, et al. Power transmission line inspection robots: A review, trends and challenges for future research[J]. International Journal of Electrical Power & Energy Systems, 2020, 118: 105862. [11] MENG F Q, XU B, ZHANG T W, et al. Application of AI in image recognition technology for power line inspection[J]. Energy Systems, 2020, 2(4): 124-128. [12] MATIKAINEN L, LEHTOMÄKI M, AHOKAS E, et al. Remote sensing methods for power line corridor surveys[J]. ISPRS Journal of Photogrammetry and Remote sensing, 2016, 119: 10-31. doi: 10.1016/j.isprsjprs.2016.04.011 [13] RAHUL K, RAHEMAN H, PARADKAR V. Design and development of a 5R 2DOF parallel robot arm for handling paper pot seedlings in a vegetable transplanter[J]. Computers and Electronics in Agriculture, 2019, 166: 105014. doi: 10.1016/j.compag.2019.105014 [14] HUANG L, ZHOU M C, HAO K, et al. A survey of multi-robot regular and adversarial patrolling[J]. Journal of Sensors, 2019, 6(4): 894-903. [15] SA I, CORKE P. Vertical infrastructure inspection using a quadcopter and shared autonomy control[C]//Field and Service Robotics. Berlin, Heidelberg: Springer, 2014: 219-232. [16] LUO S M, TIAN L. Development of automatic line-tracking inspection device for high voltage transmission lines based on ground control[C]//2011 IEEE International Conference on Computer Science and Automation Engineering. [S.l.]: IEEE, 2011, 3: 422-426. [17] HU M L, LIU W D, LU J Q, et al. On the joint design of routing and scheduling for vehicle-assisted multi-UAV inspection[J]. Future Generation Computer Systems, 2019, 94: 214-223. doi: 10.1016/j.future.2018.11.024 [18] ZHAI Y J, ZHAO H L, ZHAO M, et al. Design of electric patrol UAVs based on a dual antenna system[J]. Energies, 2018, 11(4): 866. doi: 10.3390/en11040866 [19] MISHRA D P, RAY P. Fault detection, location and classification of a transmission line[J]. Neural Computing and Applications, 2018, 30(5): 1377-1424. doi: 10.1007/s00521-017-3295-y [20] 琚恭伟, 焦慧敏, 张佳明, 等. 基于YOLOv5的医用外科手套左右手识别[J]. 制造业自动化, 2021, 43(12): 189-192. doi: 10.3969/j.issn.1009-0134.2021.12.046 JU G W, JIAO H M, ZHANG J M, et al. Left and right rand recognition of medical surgical gloves based on YOLOv5[J]. Manufacturing Automation, 2021, 43(12): 189-192. doi: 10.3969/j.issn.1009-0134.2021.12.046 [21] YANG Q F, ZHANG Z Q, YAN L, et al. Lightweight bird's nest location recognition method based on YOLOv4-tiny[C]//2021 IEEE International Conference on Electrical Engineering and Mechatronics Technology (ICEEMT). [S.l.]: IEEE, 2021: 402-405. [22] YU Y, CHEN G. Visual inspection application of substation based on internet of things[C]//Journal of Physics: Conference Series. [S.l.]: IOP Publishing, 2020: 012115. [23] LI J, YAN D F, LUAN K, et al. Deep learning-based bird’s nest detection on transmission lines using UAV imagery[J]. Applied Sciences, 2020, 10(18): 6147. doi: 10.3390/app10186147 [24] WOO S, PARK J, LEE J Y, et al. Cbam: Convolutional block attention module[C]//Proceedings of the European Conference on Computer Vision (ECCV). Munich: [s.n.], 2018: 3-19. [25] HU J, SHEN L, SUN G. Squeeze-and-Excitation networks[C]//Proceedings of the IEEE Conference On Computer Vision And Pattern Recognition. [S.l.]: IEEE, 2018: 7132-7141. [26] LIN T Y, DOLLÁR P, GIRSHICK R, et al. Feature pyramid networks for object detection[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. [S.l.]: IEEE, 2017: 2117-2125. [27] LIU S, QI L, QIN H F, et al. Path aggregation network for instance segmentation[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. [S.l.]: IEEE, 2018: 8759-8768. [28] WANG S. Substation personnel safety detection network based on YOLOv4[C]//2021 IEEE 2nd International Conference on Big Data, Artificial Intelligence and Internet of Things Engineering (ICBAIE). [S.l.]: IEEE, 2021: 877-881. [29] YANG B, QIN H, XIE H, et al. Helmet detection under the power construction scene based on image analysis[C]//2019 IEEE 7th International Conference on Computer Science and Network Technology (ICCSNT). [S.l.]: IEEE, 2019: 67-71. [30] ZHENG Z H, WANG P, REN D W, et al. Enhancing geometric factors in model learning and inference for object detection and instance segmentation[J]. IEEE Transactions on Cybernetics, 2021, 52(8): 8574-8586. [31] BOCHKOVSKIY A, WANG CHIEN-YAO, LIAO H Y M. Yolov4: Optimal speed and accuracy of object detection[EB/OL]. [2022-01-20]. https://doi.org/10.48550/arXiv.2004.10934. -

ISSN

ISSN

下载:

下载: