-

在过去几年中,机器学习作为一个跨学科领域迅速发展。机器学习技术也成功应用于计算机视觉、数据挖掘等多个领域[1-5]。20世纪初叶,物理学家对原子和辐射原理的逐渐了解,推动了量子力学现代理论的诞生。量子力学的出现成为科学中不可缺少的一部分,其中包括原子结构、恒星核聚变、超导体、DNA结构和自然界基本粒子等。量子计算是基于量子力学而非经典物理学的思想进行计算,比经典计算更强大。20世纪后,量子物理和机器学习的结合,提出了一个新颖、实用的概念−量子神经网络(quantum neural network, QNN)。在量子计算机上,量子神经网络是一种有用的学习工具,量子计算机能够对量子态的叠加进行大规模并行计算,提供潜在的指数加速,以较低的成本提取最优网络框架[6-11]。量子神经网络提高了网络的准确性、泛化性和鲁棒性等性能[12-14],这得到了学界的深度重视。早在1995年,文献[15]最先提出了量子神经网络的概念。之后,国内外研究人员开始对神经网络模型进行进一步的研究。2003年,文献[16]提出一种简单的量子神经网络模型及其训练方法,证明了量子神经网络与经典的学习算法相比具有一些优势。之后,研究更加深入,学者们开始着重探索QNN模型。2005年,文献[17]利用QNN和CNN(convolution neural network)对倒立摆的摆动和稳定控制进行了仿真实验,该实验具有很强的非线性关系,需要快速的识别能力。仿真结果表明,与CNN相比,QNN能够更有效地控制运动目标,是一种利用神经计算提高非完整对象控制能力的有效方法。2013年,文献[18]结合薛定谔波动方程,提出了一种新的神经信息处理体系结构,该结构称为递归量子神经网络(recurrent quantum neural network, RQNN)。RQNN可以将非平稳随机信号描述为时变的波包,文献[18]使用简单信号对RQNN进行评估,结果表明RQNN在对含有3种不同噪声水平的直流信号进行滤波时,效果明显优于卡尔曼滤波。2014年,文献[19]介绍了一种系统的QNN研究方法,将神经计算的非线性耗散动力学与量子计算的线性统一动力学结合起来,充分利用了基于耗散量子计算的开放量子神经网络思想。2018年,文献[20]证明了对于一大类合理的参数化量子电路,沿任何合理方向的梯度从非零到某一固定精度的概率是量子比特数的指数函数。2021年,文献[21]将费希尔信息谱与贫瘠高原联系起来,首次证明,设计良好的量子神经网络比经典神经网络具有更高的有效维数和更快的训练能力。多年来,量子神经网络取得了非凡的发展,这对更快的计算需求产生了巨大影响,为解决经典计算机无法解决的问题提供了前所未有的可能性。

卷积神经网络(CNN)是人工神经网络的一种,卷积神经网络的研究始于20世纪80~90年代。1987年,文献[22]提出了第一个卷积神经网络−时间延迟网络(time delay neural network, TDNN),TDNN使用BP框架进行学习,实验证明,在同等条件下TDNN的性能超过了当时的主流算法−隐马尔可夫模型(hidden markov model, HMM)。1995年,文献[23]开发了几种用于医学图像模式识别的卷积神经网络训练方法。为了提高神经网络的性能,还提出了一种利用旋转和平移不变性的非常规方法。该人工神经网络通过反向传播训练形成卷积核的权值,神经网络可作为最终的检测分类器来确定可疑图像区域上是否显示了疾病模式。性能研究表明,该技术在临床环境中具有潜在的应用前景。随着深度学习的发展,卷积神经网络开始进入人们的视线。相应地,互联网时代的到来,信息量呈爆炸式增长,对内存和时间效率的要求越来越高,这成为了一个难以解决的问题。量子计算由于其固有的叠加和纠缠特性,不仅使得量子计算范式优于传统的人工神经网络,而且量子计算机可以同时存储更多的比特信息,其存储单元是经典计算机存储单元的指数倍,这为解决卷积神经网络内存不足的问题提供了方向。一方面,量子卷积神经网络从量子物理学的角度出发,利用量子计算的高并行性,在处理海量数据方面时,显著提高了传统机器学习的运算效率,实现了高效的信息提取和分类[24];另一方面,在量子卷积层中,单个量子门仅对相邻的量子比特施加运算,并且在同一个量子卷积层内,所有量子门具有相同的可调参数,保留了卷积神经网络中局部连接和权值共享的特性。这两个特性使得量子卷积神经网络能够有效地提取图像特征,降低网络模型复杂度,显著提升模型的运算效率。正是由于这种优势,为未来量子机器学习带来更广泛的应用能力[25-26]。然而,如何设计更高效的量子态编码方式,如何构造更通用的量子电路模型体现卷积的特性,如何实现更有效的优化算法等问题仍待进一步研究。面向经典图像数据处理任务。

本文在前人工作的基础上提出了一种基于参数化量子电路的量子卷积神经网络模型。首先,对图像数据进行预处理,包括下采样和归一化处理。预处理后,对图像采用量子比特编码的方式,编码为量子态。接着构建参数化量子卷积神经网络模型,简单来说,是量子卷积层、量子池化层、量子全连接层的组合。最后,固定测量指定量子比特位,对输出结果采用随机梯度下降(stochastic gradient descent, SGD)方法优化模型参数,促使输出结果接近期望值。

本文的突出贡献主要表现在设计了一种全新的具有强纠缠特性的参数化量子线路,该量子线路能够高效地提取出图像的高维特征信息,并对特征信息进行较为准确的分类。实验结果表明,通过和其他研究者提出的模型进行对比,该量子线路在包含较少的量子参数前提下,量子线路仍具有很高的分类准确率和较快的收敛速度。不仅简化了量子线路的深度和复杂度,而且提高了量子参数的利用率,为以后对量子卷积神经网络的研究打下了基础。

-

卷积神经网络是一种包含卷积计算的深层前馈神经网络,是深度学习的代表算法之一[27-28]。该网络算法尤其适用于处理具有网格结构的图像数据[29-30] ,是目前图像处理领域应用最广泛的模型之一。CNN的成功与人类大脑视觉原理的研究息息相关,人类视觉通过逐层分级对物体认知,从瞳孔摄入像素开始,首先通过大脑皮层做一些提取特征的初步处理,接着对特征进行高级提取,并组合成相应图像,最终大脑达到区分物体的效果。CNN的灵感来源于人类视觉原理的这个特点。

常见的CNN模型由5个基本模块组成:输入层、卷积层、池化层、全连接层和输出层。在图像分类中,输入层需要对输入的数据进行预处理操作,其中包括:像素归一化、像素中心化、像素标准化、PCA/SVD降维等;对预处理后的数据作为卷积层的输入,卷积层的主要功能是利用卷积运算从输入数据中提取矩形特征图,其中每一次卷积运算都与卷积核的大小、步长、个数有关。卷积核具有局部感受野的特性,用来提取图像数据的局部特征,组成这一层卷积层的特征图;特征图作为池化层的输入,进行特征选择和信息过滤。为了降低数据维度,采用池化操作,进行下采样。下采样的方法分为最大值下采样(max-pooling)与平均值下采样(mean-pooling);卷积神经网络中的全连接层位于隐含层的最后部分,全连接层的作用则是对提取的特征进行非线性组合以得到输出,利用现有的高阶特征完成学习目标;对于图像分类问题,由输出层使用逻辑函数或归一化指数函数输出分类标签。CNN包括多重卷积层和池化层,它们结构复杂,通过多重非线性变换对大量数据进行学习,在计算机视觉中表现出非常高的性能,取得了超越传统算法的效果。经典卷积神经网络的过程示意图如图1所示。

-

为了尽可能地提取图像的特征信息。预处理包括图像下采样和图像归一化。图像下采样不但可以保留图像的大部分特征信息,而且可以降低对量子比特位数的需求。图像归一化影响网络反向传播的梯度,具有防止梯度消失和梯度爆炸的作用,同时也加快了网络的训练和收敛的速度。图像预处理完成后,采用量子比特数据编码的方式对特征信息量子化,将量子态信息输入提出的新模型中。

-

在 NISQ (noisy intermediate-scale quantum)时代,量子计算机受到量子比特位数和量子电路深度的限制,使得量子分类变得困难,目前还无法构建出不受限制的量子计算机。简单来说,图像的大小决定量子比特的位数,图像的大小对于当前的量子计算机会有一定的限制。为了减轻量子比特位数的限制,采用高斯金字塔下采样的方式[31],高斯金字塔示意图如图2所示。将原始图像进行高斯滤波操作,设

$ {{{G}}_{{l}}} $ 作为高斯金字塔的第$ l $ 层,原始图像为$ {{{G}}_{\text{0}}} $ ,则有:$$ {G_l}(i,j) = \sum\limits_{m = - 2}^2 {\sum\limits_{n = - 2}^2 {{{{\boldsymbol{w}}({{m}},{{n}})}}{G_{l - 1}}(2i + m,2j + n)} } $$ 式中,

$ i $ 和$ j $ 表示高斯金字塔第$ l $ 层图像中像素点的坐标;$ {{{\boldsymbol{w}}({{m}},{{n}})}} $ 是一个二维的5×5高斯滤波器,表达式为:$$ {{{\boldsymbol{w}}({{m}},{{n}})}} = \frac{1}{{256}}\left\{ {\begin{array}{*{20}{c}} 1&4&6&4&1\\ 4&{16}&{24}&{16}&4\\ 6&{24}&{36}&{24}&6\\ 4&{16}&{24}&{16}&4\\ 1&4&6&4&1 \end{array}} \right\} $$ 滤波操作完成后,删除原始图像信息的偶数行和偶数列,原始图像的大小尺寸变成了原先的一半。按照上述步骤生成的

$ {{{G}}_{\text{0}}}{\text{,}}{{{G}}_{\text{1}}}{\text{,}} \cdots {\text{,}}{{{G}}_{{N}}} $ 构成了图像的高斯金字塔,其中$ {{{G}}_{\text{0}}} $ 为金字塔底层,$ {{{G}}_{{N}}} $ 为金字塔顶层。图2简要概括了高斯金字塔的采样过程,其中$ {{{G}}_{\text{0}}} $ 为8×8像素的金字塔底层,经过高斯低通滤波后,转换为4×4像素的$ {{{G}}_{\text{1}}} $ 层,完成了数据的一次 下采样。该实验数据集为28×28大小的MNIST数据集,经过3次高斯金字塔下采样后,原始图像大小尺寸变为4×4像素的灰度图像,保留了原始图像的部分特征信息。 -

对于图像数据来说,图像的像素值是介于0~255之间的整数。在深度神经网络训练进行拟合时,一般使用较小的权重值,如果当训练数据的值较大时,可能会减慢模型训练的过程,因此,对图像数据进行像素归一化是有必要的。本文采用Min-max归一化,目的在于去除图像数据的像素单位,将数据转化为无量纲的纯数值,具体来说,像素归一化后将图像像素值缩放到[0,1]之间,Min-max归一化可由下式得出:

$$ {p_{{\rm{new}}}}(i,j) = \frac{{p(i,j) - {p_{\min }}}}{{{p_{\max }} - {p_{\min }}}} $$ 式中,

$ p(i,j) $ 为在像素位置$ (i,j) $ 的像素值;$ {p_{\max }} $ 和$ {p_{\min }} $ 分别为图像像素值的最大值和最小值;$ {p_{{\rm{new}}}}(i,j) $ 为像素归一化后像素位置$ (i,j) $ 的新像素值。归一化后,图像的特征信息在数值上有了一定的比较性,大大提高了分类器的准确性。 -

图像数据经过预处理后,利用量子旋转门

$ {R_x}(\theta ) $ 对图像数据进行量子态编码转换为量子态信息,量子态信息作为量子卷积神经网络模型的输入,经过一系列变换后完成图像的分类。本文采用量子比特编码的方式,将像素值信息映射为量子态,图像像素值信息$ {p_{{\rm{new}}}}(i,j) $ 与量子旋转门$ {R_x}(\theta ) $ 的旋转角度$ \theta $ 具有如下关系[32]:$$ {\theta _{(i,j)}} = {p_{{\rm{new}}}}(i,j) \times {\text{π }} $$ 图像的特征信息被转换为量子旋转门的角度,每一个像素值都为量子旋转门

$ {R_x}(\theta ) $ 提供了相应的参数,不同的量子旋转门$ {R_x}(\theta ) $ 作用在相应的量子位初始态$ \left| 0 \right\rangle $ 上,特征信息保留在量子态中,完成了图像数据的量子态制备,量子态信息即可作为量子卷积神经网络模型的输入。数据的量子态制备示意图如图3所示。 -

本节详细介绍该网络的量子卷积层、量子池化层、量子全连接层的内部结构。

-

量子卷积层由多个参数化量子滤波器组成,量子滤波器类似于经典卷积层中的卷积核,量子卷积层使用参数化量子滤波器对数据的局部空间所有量子位进行特征提取(特征图)。对整个网络模型起到了提取量子位复杂特征信息的重要作用。量子滤波器包含多种类的量子比特门,其中包括单量子比特门和双量子比特门,它们可以对相应的量子比特位进行幺正变换,双量子比特门作用于相邻的量子比特上,实现了相邻量子比特的量子纠缠。该网络既融入了量子力学中的独有特性,也保留了卷积核权值共享的特点。本文采用类似于文献[33]提出的量子线路,该量子线路由CNOT门、

$ {R_x}(\theta ) $ 旋转门和旋转门组成,如图4所示,卷积核U具有7个可调整的参数。 -

量子池化层和经典池化层相似,为了对量子卷积层所提取的特征进行降维,该网络使用量子池化层,对量子态特征进行量子池化操作,去除了冗余信息、简化网络的复杂度。同时量子池化层提取到了复杂的特征信息,提高了模型的准确精度。量子池化层包含多个量子测量操作和经典受控量子门,其中经典受控量子门依据测量结果,对所作用的量子位施加不同的幺正变换。本文精心设计了量子池化层的电路结构,如图5所示。在量子线路中加入CNOT门、

$ {R_y}(\theta ) $ 旋转门和$ {R_z}(\theta ) $ 旋转门,参数化量子门施加于相邻量子比特上,完成对量子态局部概率幅进行特征融合的同时作降维采样处理。其中,$ {R^\dagger }_z(\theta ) $ 表示$ {R_z}(\theta ) $ 的共轭转置量子门,有6个可调参数。 -

量子全连接层和经典全连接层相似,出现在网络模型的末尾。经过量子池化层降维运算,量子系统中相干量子比特的数量减少。当数量足够少时,对剩余量子比特施加量子全连接层,将特征映射到样本标记空间,量子全连接层起到了分类器的作用。本文采用强纠缠量子线路作为全连接层,它由多个通用单量子比特门和CNOT门组成。量子全连接层内部各个量子门的参数相互独立,并且强纠缠电路具有线路效率高、计算量少的优点。文献[34]已经证明,强纠缠低深度线路被视为一种强大的分类器。量子全连接层线路结构如图6所示。共包含12个可训练的参数。所提取的特征信息仍保留在输出量子比特的量子态中,需要通过量子测量进行提取利用,固定选取一个量子比特进行测量,并将测量结果映射为量子卷积神经网络的判别结果。其中,量子测量的原理是对该量子态进行测量,使叠加态波包塌缩到一个基态,对量子系统的输出执行Z基测量,得到量子系统的输出。即:

$$ E = {\left\langle \varphi \right|_{{\rm{in}}}}{\left( {F({\theta _3})V({\theta _2})U({\theta _1})} \right)^\dagger }Z\left( {F({\theta _3})V({\theta _2})U({\theta _1})} \right){\left| \varphi \right\rangle _{{\rm{in}}}} $$ 式中,

$ {\left| \varphi \right\rangle _{{\rm{in}}}} $ 为输入图像的量子态;$ U({\theta _1}) $ 为网络卷积层中具有训练参数的酉算子的乘积;$ V({\theta _2}) $ 、$ F({\theta _3}) $ 为网络池化层、全连接层中具有训练参数的酉算子。考虑到量子测量的概率性,为减少量子卷积神经网络模型的输出方差,实验选取多次测量结果的均值作为单个量子比特的输出值。

-

仿真实验使用TensorFlow Quantum量子计算框架[35]作为模型搭建平台,实验数据都是在配备11th Gen Intel(R) Core(TM) i7-11800H和16 GB RAM的笔记本电脑上收集的。本文展示了一种在MNIST数据集上的图像识别任务,通过结果分析来验证量子卷积神经网络的学习能力。该实验模拟了图像的预处理、图像量子态的制备、完整的量子卷积神经网络模型。模型由量子卷积层、量子池化层和量子全连接层组合而成。对比不同层数的QCNN模型的学习能力,即一个具有三层量子卷积层和三层量子池化层结构的模型;另一个有两层量子卷积层和两层量子池化层结构的模型。两种QCNN模型分别对两类灰度图像识别任务{0,1}、{2,7}进行实验分析,采用控制变量法,两种模型使用相同的预处理方法、量子态制备方法、损失函数、梯度下降函数、数据集、测试集。随机选取{0,1}、{2,7}两类数据集组成训练集和测试集,训练集包括1000个训练样本,分别包含500张数字0和1的样本,测试集包括250个测试样本,分别包含125张数字0和1的样本,{2,7}数据集样本分布和{0,1}相同。

-

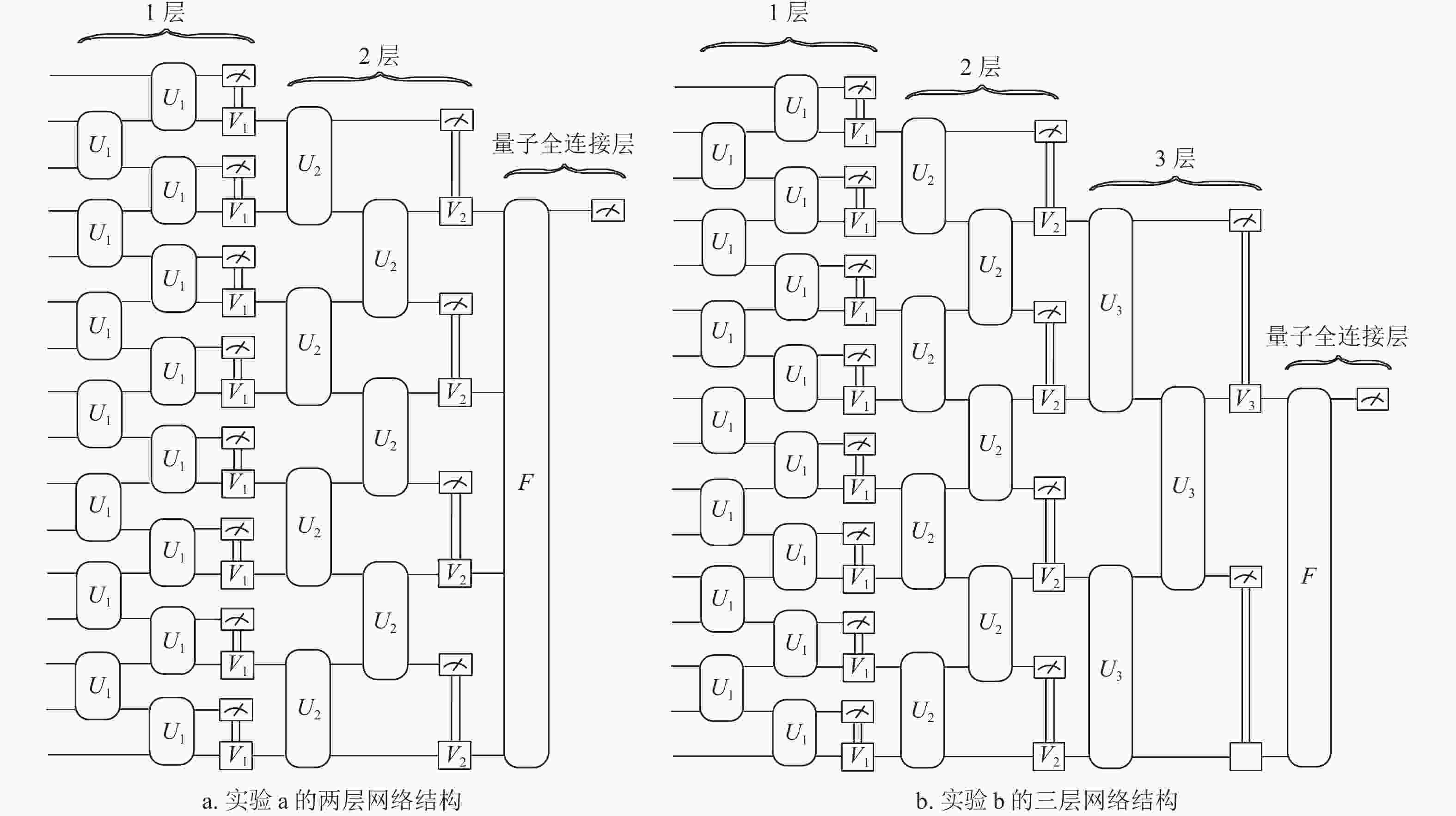

本文将28×28像素的手写数字样本采用高斯金字塔下采样的方式,将手写数字样本下采样为4×4像素的灰度图像。灰度图像通过Min-max归一化操作和量子数据编码后,会有16个输入量子比特作为QCNN的输入,每经过一层量子池化,量子比特的数量缩减为原来的一半。由于量子卷积层和量子池化层具有权值共享的特点,每一层的参数数量保持不变。本文使用不同层数的量子卷积层和量子池化层做对比实验,实验a按照两层量子卷积层和两层量子池化层的比例构建模型,包含42个可训练参数;实验b按照三层量子卷积层和三层池化层的比例构建模型,包含51个可训练参数。实验a和b所用模型如图7所示。

实验a的训练迭代次数为100;批次大小为64;学习率为0.3,损失函数定义为均方误差(mean square error, MSE),它是预测值

$ f(x) $ 与目标值$ y $ 之间差值平方和的均值,如下式所示:$$ {\rm{MSE}} = {{\displaystyle\sum\limits_{i = 1}^n {(f(} x) - y{)^2}}}/{n} $$ 两个数据集的损失值和准确率曲线如图8所示。分析曲线分布可以明显地看出,实验b相比实验a有更高的分类准确率和更稳定的损失函数。其中,{0,1}分类中实验a的准确率为96%,实验b的准确率100%;{2,7}分类中实验a的准确率为96%,实验b的准确率100%。三层网络模型结构对{0,1},{2,7}分类效果显著,准确率达到了100%,并且损失函数收敛的速度更快。三层网络模型结构相比于两层网络模型结构,三层网络模型结构具有更强的学习能力和泛化性能。增加模型层数和模型参数对分类效果的提升较大,提高了模型的分类准确率和泛化能力。

-

所提出的三层网络模型的QCNN结构在{0,1}分类和{2,7}分类中,准确率可达到100%。为了提高量子线路的特征提取率和分辨率,更好地适应其他二分类任务,本文改变数据集样本的下采样方法,采用平均池化下采样策略,对图像预处理进行进一步的改善。2022年,文献[36]提出了一种混合量子神经网络来实现现实世界数据集的多分类任务,证明了平均池化下采样策略的可行性。平均池化下采样通过空白切割和平均池化操作,首先将28×28像素的数据样本空白切割为20×20灰度图像,丢弃每个边界上几乎没有有用信息的像素块。再对20×20灰度图像进行平均池化,将20×20灰度图像分为16组5×5的像素块,计算每个5×5像素块的平均值,得到4×4灰度图像。

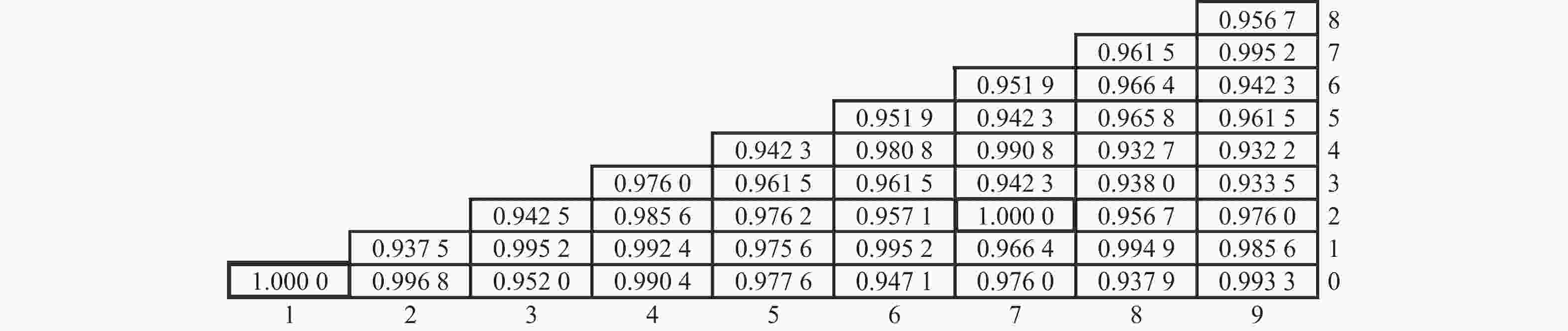

实验使用经过平均池化预处理后的4×4像素的灰度图像,经过量子态制备后作为模型的输入,执行{0-9}中每对数字的二分类任务。该实验使用三层量子卷积层和三层池化层的模型,包含51个可训练参数。实验批次大小为8;学习率为0.1;损失函数定义为交叉熵函数,公式如下所示:

$$ L = - \frac{1}{N}\sum\limits_i {\left[ {{y_i} \cdot \log \left( {{p_i}} \right) + \left( {1 - {y_i}} \right) \cdot \log \left( {1 - {p_i}} \right)} \right]} $$ 式中,

$ {y_i} $ 表示样本$ i $ 的标签,正类为1,负类为0;$ {p_i} $ 表示预测样本$ i $ 为正类的概率;$ N $ 是测试集样本的数量。在{0-9}样本中,每对数字共有$ C_{10}^2 = 45 $ 个分类任务。对所有二分类任务进行模拟实验,实验结果如图9所示。通过分析图9,除了{0,1}分类和{2,7}分类外,三层网络结构的QCNN对数字0和数字2的分类准确率最高,达到了99.68%。对数字4和数字9的分类准确率最低,但也达到了93.22%。经过平均池化策略后的数字4和数字9视觉观察效果相似,提取的特征相似度大,相比于其他数字,模型的识别难度会增大许多。但是,该模型是基于16位量子比特的输入,当量子位可以不再受到严格的限制时,模型对量子态特征的提取将会更加全面,相信这个问题在不久的将来会得到一个合理的解决。

此外,将本文提出的三层网络结构与其他方法进行了比较。文献[37]训练了一个张量网络,该模型可以减少处理高维数据所需的量子比特数,共包含1008个参数。文献[37]使用MNIST数据集执行二分类任务,得到了45个分类任务的结果,其中该模型对{0,1}、{0,4}、{1,9}分类准确率最高,对{3,5}、{4,9}、{7,9}分类准确率最低。文献[38]使用Tree Tensor Network (TTN)、Multi-scale Entanglement Renormalization Ansatz (MERA)和一个经过TTN预训练的MERA来处理4个二分类任务,包括{0,1}、{2,7}和奇偶数,是否大于4进行分类。在相同的任务上,该实验使用三层结构的QCNN网络模型,下采样采用平均池化策略,实验结果如表1所示。可以看出,本文的网络模型和张量网络模型相比,在6个分类任务中,分类准确率更突出,模型性能更稳定,对MNIST数据集适用性更高。另外,本文模型包含51个参数,参数个数远小于文献[37]提出的张量网络模型,充分发挥了量子卷积层和量子池化层的特征提取的作用,减少了计算复杂度。QCNN模型和文献[38]提出的模型相比,在对数字{0,1}和{2,7}和对大于4的数分类任务中,本文网络模型准确率超过了文献[38]提出的模型,但在奇偶分类任务中,准确率并不突出,但准确率也达到了81.35%。QCNN模型的性能在多数方面超过了它们,但在奇偶分类中还需要网络模型的进一步完善,表明了QCNN对这些任务有一定的处理能力,并且还可以通过完善模型线路,使模型分类准确率进一步提升。

-

本文提出了一种面向图像识别的强纠缠参数化量子卷积神经网络,详细阐述了网络模型内部结构的理论基础,该网络模型对MNIST数据集进行多种二分类任务。通过对参数个数为51的三层网络模型和参数个数为42的两层网络模型进行对比,三层网络的QCNN模型在{0,1}和{2,7}分类中,性能表现更加出色,具有较强的学习能力,分类准确率均达到了100%,并且损失函数收敛速度更快。为了进一步提高模型的泛化能力,同时考虑到NISQ设备中可用的量子位数量的有限性,本文采用平均池化策略对原始图像进行下采样处理。与传统方法相比,它保留了更多的数据特征。对采用平均池化策略的模型模拟了一个相对全面的数值实验,与其他方法进行比较,本文提出的QCNN模型在MNIST数据集识别方面有效地完成了图像的二分类任务,显示出了竞争性的识别结果,并且在学习时具有稳定的量子机器性能。与经典CNN相比,利用量子力学的量子态叠加和量子态纠缠特性,解决了模型对内存和时间问题,证明了QCNN在图像分类任务中具有良好的应用前景。但在奇偶分类方面,还需要研究更高效、学习性能更好的QCNN模型来提高奇偶分类的准确率。接下来,计划将QCNN模型应用于更复杂的数据分类任务,这些问题将是未来的研究重点。相信随着大规模量子设备的出现,量子位数量的有限性将会得到合理解决,从而可以最大限度地提取原始图像的特征信息,达到优化模型的学习能力和适应能力的效果。

A New Model of Image Recognition Based on Quantum Convolutional Neural Network

-

摘要: 为了解决卷积神经网络对内存和时间效率要求越来越高的问题,提出一种面向数字图像分类的新模型,该模型为基于强纠缠参数化线路的量子卷积神经网络。首先对经典图像进行预处理和量子比特编码,提取图像的特征信息,并将其制备为量子态作为量子卷积神经网络模型的输入。通过设计模型量子卷积层、量子池化层、量子全连接层结构,高效提炼主要特征信息,最后对模型输出执行Z基测量,根据期望值完成图像分类。实验数据集为MNIST数据,{0,1}分类和{2,7}分类准确率均达到了100%。对比结果表明,采用平均池化下采样的三层网络结构的QCNN模型具有更高的测试精度。Abstract: In order to solve the problem that convolutional neural network requires higher and higher memory and time efficiency, a new model for digital image classification is proposed in this paper. The model is a quantum convolutional neural network based on strongly entangled parameterized circuits. Firstly, the classical image is preprocessed and qubit-encoded, and the image feature information is prepared as a quantum state, which is used as the input of the quantum convolutional neural network model. The quantum convolutional layer, quantum pooling layer and quantum full connection layer of the model are designed to extract the main feature information efficiently. Finally, the Z-based measurement is performed on the model output, and the image classification is completed according to the expected value. In this work, the experimental data set is MNIST data. The classification accuracy of {0,1} and {2,7} classification reached 100%. The comparison experimental results show that the QCNN model of the three-layer network structure with average pooling downsampling has higher test accuracy.

-

[1] POGGIO T, SHELTON C R. Machine learning, machine vision, and the brain[J]. AI Magazine, 1999, 20(3): 37-37. [2] BENBARRAD T, SALHAOUI M, KENITAR S B, et al. Intelligent machine vision model for defective product inspection based on machine learning[J]. Journal of Sensor and Actuator Networks, 2021, 10(1): 7. doi: 10.3390/jsan10010007 [3] LAVRAČ N. Machine learning for data mining in medicine[C]//Joint European Conference on Artificial Intelligence in Medicine and Medical Decision Making. Berlin, Heidelberg: Springer, 1999: 47-62. [4] TENG X, GONG Y. Research on application of machine learning in data mining[C]//IOP Conference Series: Materials Science and Engineering. [S.l.]: IOP Publishing, 2018, 392(6): 062202. [5] YAN D D, FAN X K, CHEN Z Y, et al. Low-Loss belief propagation decoder with Tanner graph in quantum error-correction codes[J]. Chinese Physics B, 2022, 31(1): 178-184. [6] ARUTE F, ARYA K, BABBUSH R, et al. Quantum supremacy using a programmable superconducting processor[J]. Nature, 2019, 574(7779): 505-510. doi: 10.1038/s41586-019-1666-5 [7] 郑瑾, 高庆, 吕颜轩, 等. 基于参数化量子电路的量子卷积神经网络模型及应用[J]. 控制理论与应用, 2021, 38(11): 1772-1784. doi: 10.7641/CTA.2021.10786 ZHENG J, GAO Q, LYU Y X, et al. Quantum convolution neural network model based on parametric quantum circuit and its application[J]. Control Theory & Applications, 2021, 38(11): 1772-1784. doi: 10.7641/CTA.2021.10786 [8] HENDERSON M, SHAKYA S, PRADHAN S, et al. Quanvolutional neural networks: Powering image recognition with quantum circuits[J]. Quantum Machine Intelligence, 2020, 2(1): 1-9. doi: 10.1007/s42484-020-00013-x [9] DA SILVA A J, LUDERMIR T B, DE OLIVEIRA W R. Quantum perceptron over a field and neural network architecture selection in a quantum computer[J]. Neural Networks, 2016, 76: 55-64. doi: 10.1016/j.neunet.2016.01.002 [10] CONG I, CHOI S, LUKIN M D. Quantum convolutional neural networks[J]. Nature Physics, 2019, 15(12): 1273-1278. doi: 10.1038/s41567-019-0648-8 [11] LI Y C, ZHOU R G, XU R Q, et al. A quantum deep convolutional neural network for image recognition[J]. Quantum Science and Technology, 2020, 5(4): 044003. doi: 10.1088/2058-9565/ab9f93 [12] ZHONG H S, WANG H, DENG Y H, et al. Quantum computational advantage using photons[J]. Science, 2020, 370(6523): 1460-1463. doi: 10.1126/science.abe8770 [13] LIU G Z, LI W, FAN X K, et al. An image encryption algorithm based on discrete-time alternating quantum walk and advanced encryption standard[J]. Entropy, 2022, 24(5): 608. doi: 10.3390/e24050608 [14] 范兴奎, 颜丹丹, 刘芬, 等. 高维量子低密度奇偶校验码纠缠度[J]. 中国科学: 信息科学, 2022, 52(3): 539-552. doi: 10.1360/SSI-2021-0183 FAN X K, YAN D D, LIU F, et al. Entanglement degree of high-dimensional quantum low-density parity check codes[J]. Scientia Sinica: Informationis, 2022, 52(3): 539-552. doi: 10.1360/SSI-2021-0183 [15] KAK S C. Quantum neural computing[J]. Advances in Imaging and Electron Physics, 1995, 94: 259-313. [16] RICKS B, VENTURA D. Training a quantum neural network[C]//Advances in Neural Information Processing Systems. [S.l.]: ACM, 2004: 1-8. [17] NORIAKI K, NOBUYUKI M, HARUHIKO N, et al. An examination of qubit neural network in controlling an inverted pendulum[J]. Neural Processing Letters, 2005, 22(3): 277-290. doi: 10.1007/s11063-005-8337-2 [18] GANDHI V, PRASAD G, COYLE D, et al. Quantum neural network-based EEG filtering for a brain-computer interface[J]. IEEE Transactions on Neural Networks and Learning Systems, 2013, 25(2): 278-288. [19] SCHULD M, SINAYSKIY I, PETRUCCIONE F. The quest for a quantum neural network[J]. Quantum Information Processing, 2014, 13(11): 2567-2586. doi: 10.1007/s11128-014-0809-8 [20] MCCLEAN J R, BOIXO S, SMELYANSKIY V N, et al. Barren plateaus in quantum neural network training landscapes[J]. Nature Communications, 2018, 9(1): 1-6. doi: 10.1038/s41467-017-02088-w [21] ABBAS A, SUTTER D, ZOUFAL C, et al. The power of quantum neural networks[J]. Nature Computational Science, 2021, 1(6): 403-409. doi: 10.1038/s43588-021-00084-1 [22] WAIBEL A, HANAZAWA T, HINTON G, et al. Phoneme recognition using time-delay neural networks[J]. IEEE Transactions on Acoustics, Speech, and Signal Processing, 1989, 37(3): 328-339. doi: 10.1109/29.21701 [23] LO SHIH-CHUNG B, CHAN HEANG-PING, LIN JYH-SHYAN, et al. Artificial convolution neural network for medical image pattern recognition[J]. Neural Networks, 1995, 8(7-8): 1201-1214. doi: 10.1016/0893-6080(95)00061-5 [24] LECUN Y, BENGIO Y, HINTON G. Deep learning[J]. Nature, 2015, 521(7553): 436-444. doi: 10.1038/nature14539 [25] 姜瑶瑶, 张文彬, 初鹏程, 等. 基于置换群的多粒子环上量子行走的反馈搜索算法[J]. 物理学报, 2022, 71(3): 030201. doi: 10.7498/aps.71.20211000 JIANG Y Y, ZHANG W B, CHU P C, et al. Feedback search algorithm for multi-particle quantum walks over a ring based on permutation groups[J]. Acta Physica Sinica, 2022, 71(3): 030201. doi: 10.7498/aps.71.20211000 [26] 贺振兴, 范兴奎, 初鹏程, 等. 基于Cayley图上量子漫步的匿名通信方案[J]. 物理学报, 2020, 69(16): 47-55. doi: 10.7498/aps.69.20200333 HE Z X, FAN X K, CHU P C, et al. Anonymous communication scheme based on quantum walk on Cayley graph[J]. Acta Physica Sinica, 2020, 69(16): 47-55. doi: 10.7498/aps.69.20200333 [27] YAN L C, YOSHUA B, GEOFFREY H. Deep learning[J]. Nature, 2015, 521(7553): 436-444. [28] SAINATH T N, KINGSBURY B, SAON G, et al. Deep convolutional neural networks for large-scale speech tasks[J]. Neural Networks, 2015, 64: 39-48. doi: 10.1016/j.neunet.2014.08.005 [29] KRIZHEVSKY A, SUTSKEVER I, HINTON G E. Imagenet classification with deep convolutional neural networks[J]. Advances in Neural Information Processing Systems, 2012, 25(2): 1097-1105. [30] GU J, WANG Z, KUEN J, et al. Recent advances in convolutional neural networks[J]. Pattern Recognition, 2018, 77: 354-377. doi: 10.1016/j.patcog.2017.10.013 [31] 王爱芳, 杜培明, 王高. 基于高斯金字塔和MLP的带钢边部缺陷识别[J]. 软件导刊, 2016, 15(2): 105-108. WANG A F, DU P M, WANG G. Strip edge defect recognition based on Gaussian Pyramid and MLP[J]. Software Guide, 2016, 15(2): 105-108. [32] LIU J, LIM K H, WOOD K L, et al. Hybrid quantum-classical convolutional neural networks[J]. Science China Physics, Mechanics & Astronomy, 2021, 64(9): 1-8. [33] SHENDE V V, MARKOV I L, BULLOCK S S. Minimal universal two-qubit controlled-NOT-based circuits[J]. Physical Review A, 2004, 69(6): 062321. doi: 10.1103/PhysRevA.69.062321 [34] SCHULD M, BOCHAROV A, SVORE K M, et al. Circuit-Centric quantum classifiers[J]. Physical Review A, 2020, 101(3): 032308. doi: 10.1103/PhysRevA.101.032308 [35] BROUGHTON M, VERDON G, MCCOURT T, et al. Tensorflow quantum: A software framework for quantum machine learning[EB/OL]. [2020-05-16]. https://arxiv.org/abs/2003.02989. [36] ZENG Y, WANG H, HE J, et al. A multi-classification hybrid quantum neural network using an all-qubit multi-observable measurement strategy[J]. Entropy, 2022, 24(3): 394. doi: 10.3390/e24030394 [37] HUGGINS W, PATIL P, MITCHELL B, et al. Towards quantum machine learning with tensor networks[J]. Quantum Science and Technology, 2019, 4(2): 024001. doi: 10.1088/2058-9565/aaea94 [38] GRANT E, BENEDETTI M, CAO S, et al. Hierarchical quantum classifiers[J]. NPJ Quantum Information, 2018, 4(1): 1-8. doi: 10.1038/s41534-017-0051-1 -

ISSN

ISSN

下载:

下载: