-

随着特高压的逐渐普及,电网规模越来越大[1]。为了保障输电安全和质量,电力线路巡检越来越被世界各国重视。由于输电线架设高且多架设于崎岖地形,人工检查一方面需要花费大量的时间和精力,另一方面不可避免地存在安全风险。无人机(unmanned aerial vehicle, UAV)为输电线路提供了一种新的巡检方式,即从多个角度拍摄密集的输电线路巡检图像,建立事后人工查看照片的工作模式。“拍照和查看”的工作流程带来了巨大的工作量,因此开发一种智能缺陷检测方法来自动检查传输缺陷照片至关重要。

用于定位和分类目标物体的目标检测算法有望实现传输缺陷照片的自动检查。在深度学习发展前,目标检测依赖于基于图像处理的手工设计算法,如光流法、帧差法等。然而,传统方法普遍抗干扰、抗噪声能力较差,且较难适应光照变化。当前,基于深度学习的两阶段目标检测算法在精度上有着较好的表现。

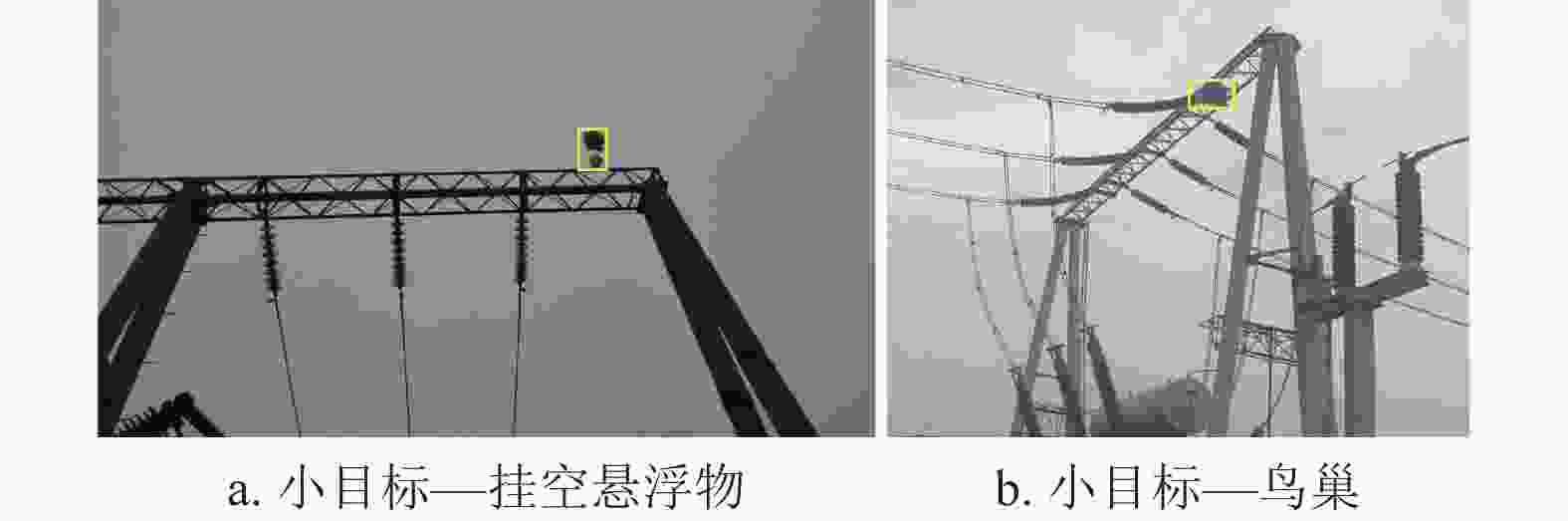

由于架空线路上的鸟巢以及塑料袋、碎布等挂空悬浮物目标多数为小目标,其包含像素少,且容易被背景干扰,导致检测较为困难。此类小目标物体的检测有着长远的研究价值,一直广受关注。一些研究证明组合不同特征层可以提升小目标检测的效果。文献[2]利用特征金字塔融合机制构建图像金字塔,并将金字塔4个不同特征层学习到的特征与SSD (single shot multibox detector)框架的原始特征进行融合用于获取全局信息。此外,他们将上一层与本层的特征进行合并以获取到局部信息。文献[3]除了组合卷积层和反卷积层的特征图外,还在“编码器−解码器”架构中使用了反卷积层,进一步提高了检测效果。除了组合不同特征层,获取上下文信息也被证明可用于提高小目标检测的效果。其中,基于注意力机制的方法通过为提取的特征分配不同权重以实现更好的上下文关联效果。挤压和激励网络(squeeze-and-excitation networks, SENet)[4]找到输入特征中每个通道的重新校准权重,并使用这些权重来提升重要通道。卷积块注意模块(convolutional block attention module, CBAM)[5]使用通道注意和空间注意来校准特征并学习更好的表示,以便网络可以在下游任务上表现更好。汇集和激发模块(GE)[6]在全局级别聚合特征,并使用汇集的信息增强局部特征的重要组成部分。

当前已有一些研究试图验证深度学习在输电线检测中的有效性。文献[7]提出了一种结合卷积神经网络和支持向量机的对绝缘子状态进行分类的方法。文献[8]介绍了深度隐含网络在绝缘子分类任务中的有效性。这两篇论文都展示了深度学习方法在传输线检测领域的潜力。一些研究人员尝试使用基于深度学习的目标检测方法来定位输电线路塔上的组件。文献[9]构建了一个具有两个前景类对象的数据集,并训练了一个六层的神经网络。文献[10-12]采用更快的基于感兴趣区域的卷积神经网络(faster R-CNN[13])算法。文献[14]提出了一种基于YOLO算法的绝缘体和减振器检测模型。这些研究仅应用基于深度学习的对象检测方法来定位塔上的组件,但未能检测到传输线照片中的缺陷。

在深度学习与输电线路的结合中,越来越多的研究集中在缺陷检测[15-16]上。采用的方法主要分为两阶段方法(如Faster R-CNN[17-18])以及一阶段方法(如YOLO或SSD)。文献[15]采用基于区域候选的卷积神经网络模型,实现绝缘子的端到端智能检测,并可以检测出故障爆炸的坐标。文献[19]通过基于 Faster R-CNN以及U-net来检测破损绝缘子的位置。文献[20]采用3种方法对输电线路异物实际数据集进行测试验证,讨论了不同参数对识别结果的影响。文献[21]进行了预测架构的级联设计和并行目标检测结果的逻辑推理,该机制可以更快地提高算法在实际项目下的应用效果。文献[22]基于YOLO搭建检测系统,使用无人机自动检查电力传输塔和绝缘体。文献[23]引入了超分辨率卷积神经网络来增强绝缘子或阻尼器故障的训练数据。文献[24]利用了在线硬样挖掘和样本平衡等的优点。这些研究为输电线路航拍图像缺陷检测提供了初步的解决方案。

本文提出了一种基于注意力获取和Soft-NMS的传输线路中鸟巢与挂空悬浮物的检测算法。对比实验结果表明,提出的方法可以有效地提高输电线路鸟巢与挂空悬浮物的检测效果。本文的主要贡献为:

1)设计了一种基于注意力机制和ResNet的主干网络,允许提取的特征进行自适应权重调整,更充分地进行上下文信息的学习,有利于鸟巢和挂空悬浮物这类小型目标的检测;

2)将Faster R-CNN中的后处理程序换为Soft-NMS。用于减少同类别检测框重叠时的漏检情况,防止小目标的丢失。

-

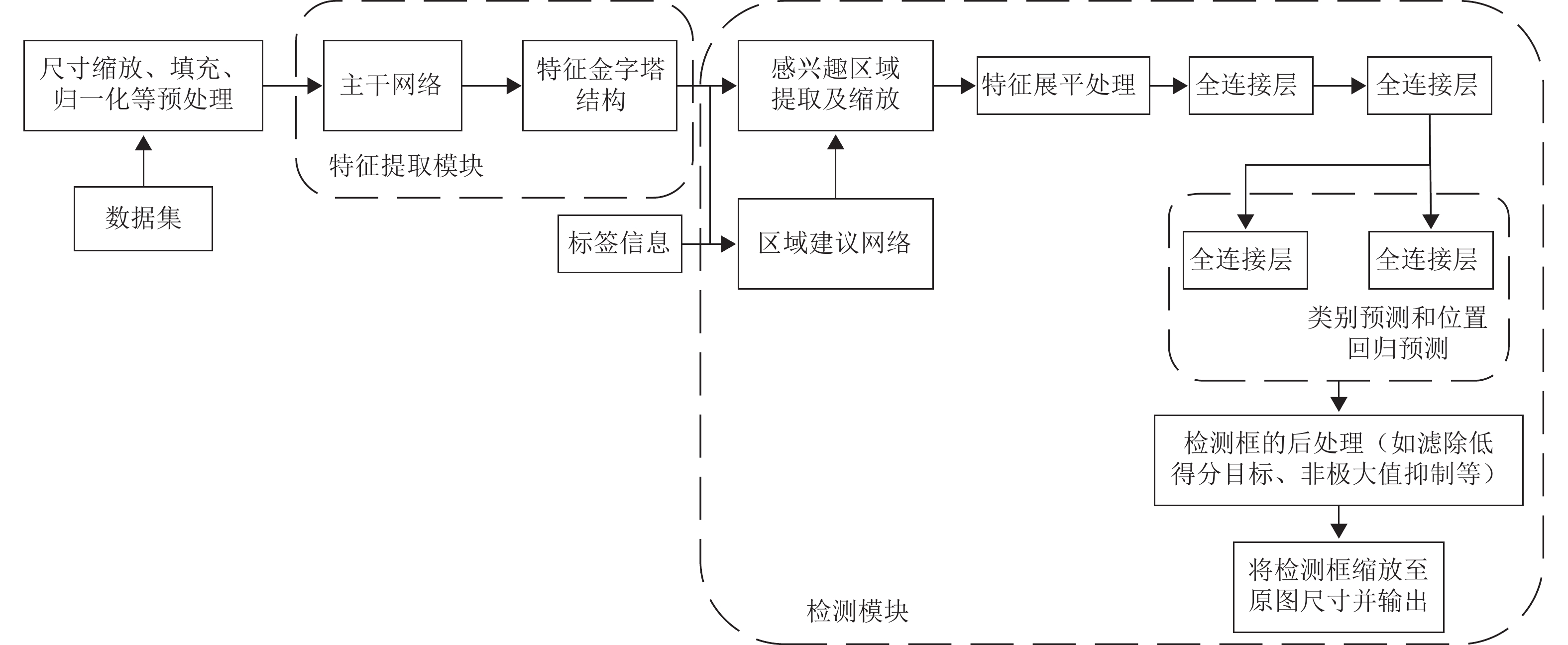

本文设计的检测网络整体框图如图1所示,其主要由特征提取模块和检测模块两部分组成。

首先,对输入的无人机图像进行尺寸缩放、填充和归一化等预处理,接着将预处理后的图像输入特征提取模块,获得其深层特征表示,以进行下一步的检测。随后,将获得的图像特征输入检测模块,结合区域建议网络产生的密集锚框和预设的筛选机制,获取本文感兴趣的鸟巢和挂空悬浮物的区域,并进一步使用全连接层对感兴趣区域中缺陷的位置和类别进行检测,输出两种缺陷的具体位置、标签和置信度。最后,对输出的检测框进行滤除和非极大值抑制等后处理,输出最终网络认为属于鸟巢和挂空悬浮物的检测结果。

-

本文设计的特征提取模块主要包括主干网络和特征金字塔结构,如图2所示。

-

主干网络被设计为嵌入注意力模块的ResNet50[25]组合式结构。主干网络主要包括C1,C2,C3,C4,C5共5个部分。其中,C1部分由一个卷积层、批归一化层[26]、Relu激活函数[27]和最大池化层构成。C2,C3,C4,C5则由参数不同而结构相同的融入注意力机制的残差块堆叠构成,所使用残差块的数量分别为3,4,6,3。预处理后的无人机图像将依次通过C1,C2,C3,C4,C5五个部分提取特征。

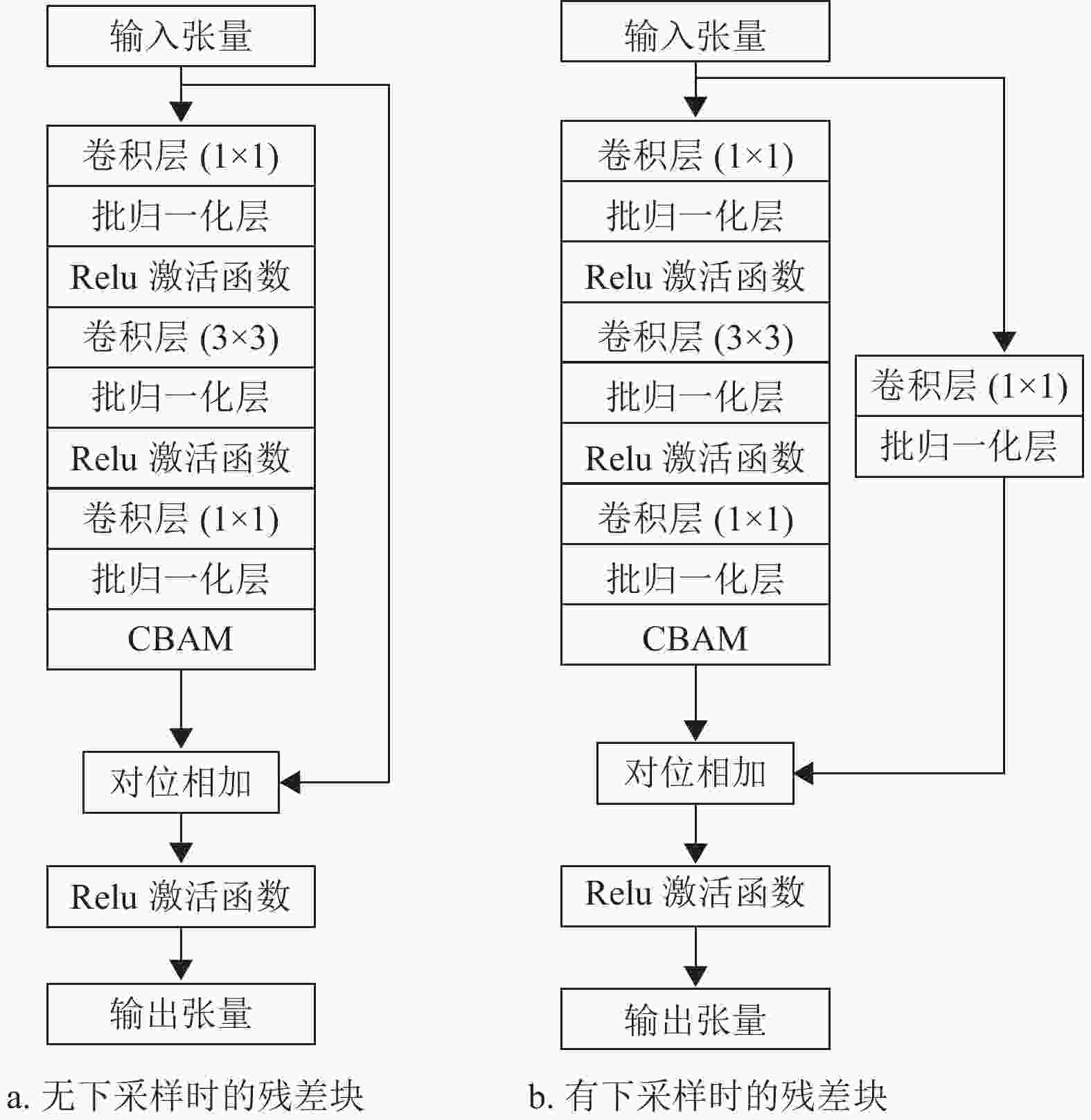

融入注意力机制的残差块是所提出主干网络的基础结构,如图3所示。每一个残差块会在输入端将输入的特征信息保留,并在末端将输入端特征信息与输出进行融合,以防止网络深度过深时梯度消失或梯度爆炸以及退化问题的发生。每个残差块由3个卷积层(分别为一个1×1卷积、3×3卷积和另一个1×1卷积)提取特征,本文选择在每个残差块的3个卷积层提取特征后,加入卷积块注意力模块,对残差块提取的特征进行更加合理的权重分配。这样的操作允许网络在训练过程中,学习到更应该关注小目标的哪些信息,从而更好地判断小目标的位置和类别。

推断一个小目标的类别和位置并不一定只依赖其本身的少量像素,还可以利用其周边信息,即上下文信息。如鸟巢更有可能出现在输电塔而不会出现在输电线路上。本文使用了CBAM结构来有效地提供这种上下文信息。

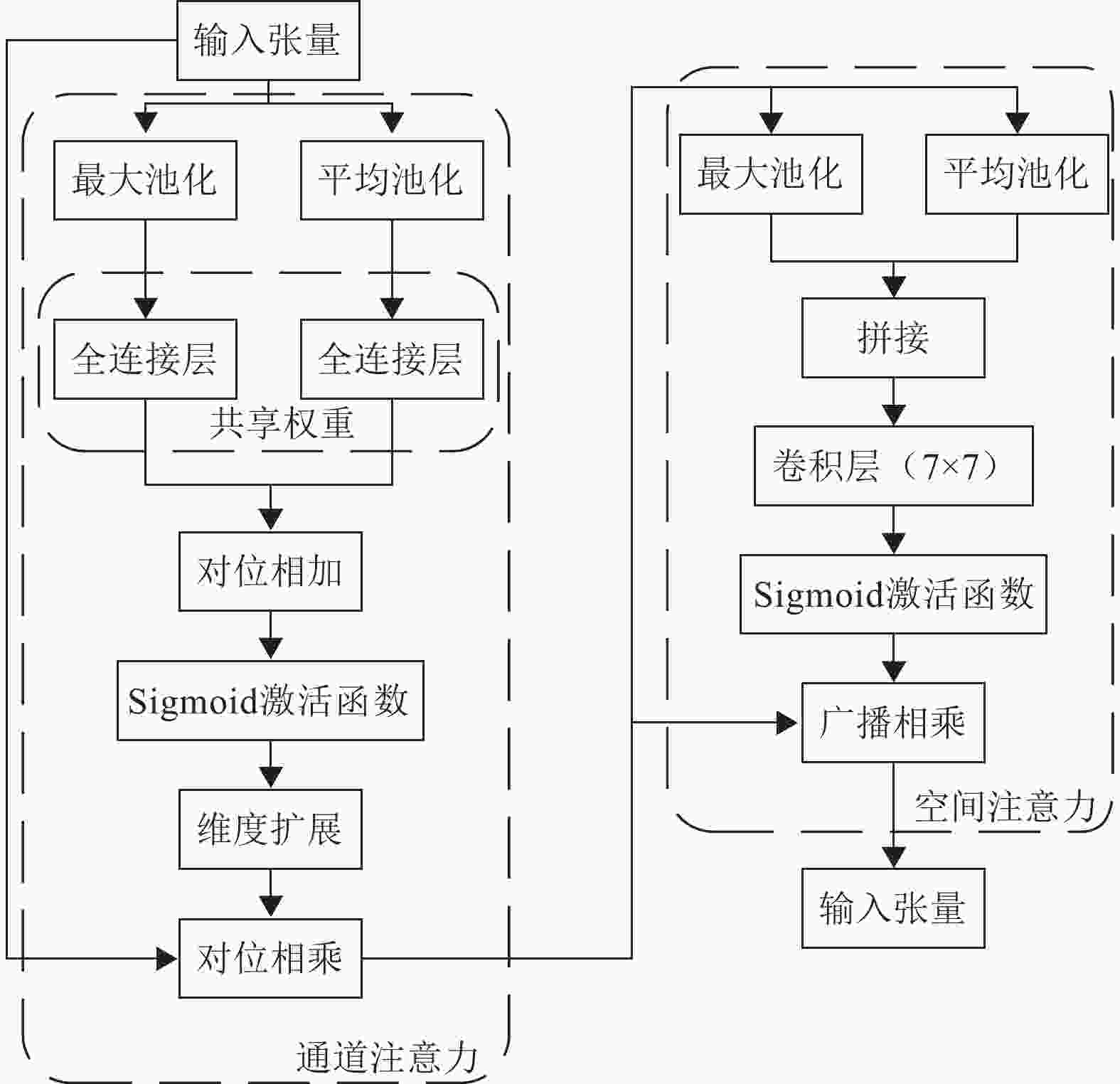

CBAM是一种由卷积层、全连接层、激活函数等组成的有效的注意力模块,结构如图4所示。给定一个尺寸为C×H×W的中间特征图,CBAM会依次计算出通道注意力图和空间注意力图,并分别将其与输入注意力模块的特征图进行广播相乘,以实现考虑了上下文信息的参数优化,如式(1)所示。

$$ {{F}}'={{F}}\ast {{{M}}}_{c}({{F}})\ast {{{M}}}_{s}({{F}}\ast {{{M}}}_{c}({{F}})) $$ (1) 式中,F为输入的张量;

${{F}}' $ 是学习到上下文信息的输出张量;Mc与Ms分别为通道注意力和空间注意力的获取过程。两个过程可以分别表示为:$$ {{{M}}_{{c}}}({{F}}) = \sigma ({\rm{MLP}}({\rm{AvgPool}}({{F}})) + {\rm{MLP}}({\rm{MaxPool}}({{F}}))) $$ (2) $$ {{{M}}_{{s}}}({{F}}) = \sigma \left( {{f^{7 \times 7}}([{\rm{AvgPool}}({{F}});{\rm{MaxPoo}}l({{F}})])} \right) $$ (3) 式中,

${\rm{AvgPool}}()$ 和${\rm{MaxPool}}()$ 分别为全局平均池化和全局最大池化操作;${f^{7 \times 7}}$ 为卷积核大小为7×7的卷积层。如图中通道注意力虚线部分所示,在通道注意力图的获取部分,特征图F分别经过基于宽度W和高度H的池化操作后,得到两个C×1×1的特征图。然后,将它们分别送入一个两层的全连接层,并将输出结果执行对位相加操作。最后,将注意力图和特征图F进行对位相乘,得到通道注意力校正后的特征图。

如图4中空间注意力虚线部分所示,输入特征图首先通过基于通道维度C的池化操作得到两个1×H×W的特征图,然后将这两个特征图在通道维度上进行拼接得到2×H×W的特征图。接下来,经过一个卷积核大小为7×7的卷积操作,将特征图重新降维为单通道。再经过Sigmoid激活函数生成空间注意力图。最后将该注意力图和与空间注意力部分的输入特征图进行广播相乘,得到最终同时考虑了通道注意力和空间注意力的特征图。

-

浅层的网络更关注像素本身包含的信息,深层次的网络则可以提炼出更准确的语义信息,因此深层次的网络更有利于准确的检测出较大的目标。Faster R-CNN只在最终特征图上进行预测,然而图像中存在不同尺寸的目标,通过深度确定的网络输出的结果并不一定完全适配。而网络深度增加后,也有可能在下采样过程中丢失小目标的信息。本文所采用的特征金字塔的设计思想就是融合主干网络中提取的低层特征和高层特征,并且分别在不同的层同时进行预测,尤其能够有效改善小目标的检测效果。

如图2所示,特征金字塔网络以主干网络的C2、C3、C4、C5结构输出的特征图作为输入,从语义信息最为丰富的最高层也就是第五层开始,进行上采样然后与第四层对位相加。融合特征图进一步与第三层以相同操作融合,依次操作,第二层融合特征图融合了所有上层的信息。各融合特征图分别经过卷积层生成用于预测的特征图。第五层融合特征图还通过最大池化层产生仅用于在区域建议网络中生成锚框和建议框的更高层特征图。

-

在检测模块中,首先通过过滤预先设定的锚框,获得代表前景区域的建议在RPN中的坐标;然后将其投影到特征提取模块生成的多尺度特征图上。根据提出的方案在特征图上分割特征矩阵,并利用ROI池化层进行平化。然后,分别通过回归层和Soft max层得到预测位置和标签信息。最后,利用后处理方法对网络的冗余输出进行过滤。

后处理算法采用柔和的非极大值抑制(Soft-NMS)算法[28]。执行过程如下。该算法对鸟巢和挂空悬浮物两个类别分别执行。

Soft-NMS 算法伪代码如下。

Input:

$\mathcal{B}=\left\{{b}_{1},{b}_{2},\cdots,{b}_{N}\right\}, \mathcal{S}=\left\{{s}_{1},{s}_{2},\cdots,{s}_{N}\right\}$ Begin

$\quad\mathcal{D}\leftarrow \{ \}$ while

$\mathcal{B}\ne {\rm{empty}} $ do$\qquad m\leftarrow \text{argmax} \mathcal{S}$ $\mathcal{M} \leftarrow { {{b} }_{{m} } }$ $\mathcal{D} \leftarrow \mathcal{D} \cup \mathcal{M}$ ;$\mathcal{B} \leftarrow \mathcal{B} - \mathcal{M}$ for

${{{b}}_{{i}}}{\text{ in}}\;\; \mathcal{B}$ do${s_i} \leftarrow {s_i}f\left( {{\rm{iou}}\left( {\mathcal{M},{b_i}} \right)} \right)$ end

end

return

$\mathcal{D},\mathcal{S}$ end

-

损失函数直接移植于Faster R-CNN的损失函数。主要包括区域建议网络和检测网络两部分损失。

其中区域建议网络的损失可以表示为:

$$ L\left( {\left\{ {{p_i}} \right\},\left\{ {{t_i}} \right\}} \right) = \frac{1}{{{N_{{\rm{cls}}}}}}\sum\limits_i {{L_{{\rm{cls}}}}} \left( {{p_i},p_i^*} \right) + \lambda \frac{1}{{{N_{{\rm{reg}}}}}}\sum\limits_i {p_i^*} {L_{{\rm{reg}}}}\left( {{t_i},t_i^*} \right) $$ (4) $$ {L_{{\rm{cls}}}} = - \log \left( {{p_i}} \right) $$ (5) $$ {{{\rm{smooth}}} _{{L_1}}}(x) = \left\{ {\begin{array}{*{20}{l}} {0.5{x^2}}&{{\text{ if }}|x| < 1} \\ {|x| - 0.5}&{{\text{ otherwise }}} \end{array}} \right. $$ (6) 式中,

${L_{{\rm{cls}}}}$ 表示前景背景的分类损失,类型为交叉熵损失;${L_{{\rm{cls}}}}$ 为初步的边界框回归损失,类型为光滑的${L_1}$ 损失;${p_i}$ 表示第$i$ 个锚框预测为真实标签的概率;$p_i^*$ 为正样本时为1,为负样本时为0;${t_i}$ 表示预测第$i$ 个锚框的边界框回归参数;$t_i^*$ 表示第$i$ 个锚框对应的真值框;${N_{{\rm{cls}}}}$ 表示一个批次中的所采样的样本数量;${N_{{\rm{reg}}}}$ 表示特征图中生成锚框的位置的个数。Fast R-CNN检测网络的损失为:

$$ L\left( {p,u,{t^u},v} \right) = {L_{{\rm{cls}}}}(p,u) + \lambda [u \geqslant 1]{L_{{\rm{loc}}}}\left( {{t^u},v} \right) $$ (7) 式中,

${L_{{\rm{cls}}}}$ 表示类别分类损失,类型为交叉熵损失;${L_{{\rm{loc}}}}$ 表示边界框回归损失,类型为光滑的${L_1}$ 损失;$p$ 为分类器预测的softmax概率分布;$u$ 为对应目标类别的真实标签;${t^u}$ 为边界框回归器预测的对应类别u的回归参数$\left( {t_x^u,t_y^u,t_w^u,t_h^u} \right)$ ;V对应真实目标的边界框回归参数$\left( {{v_x},{v_y},{v_w},{v_h}} \right)$ 。 -

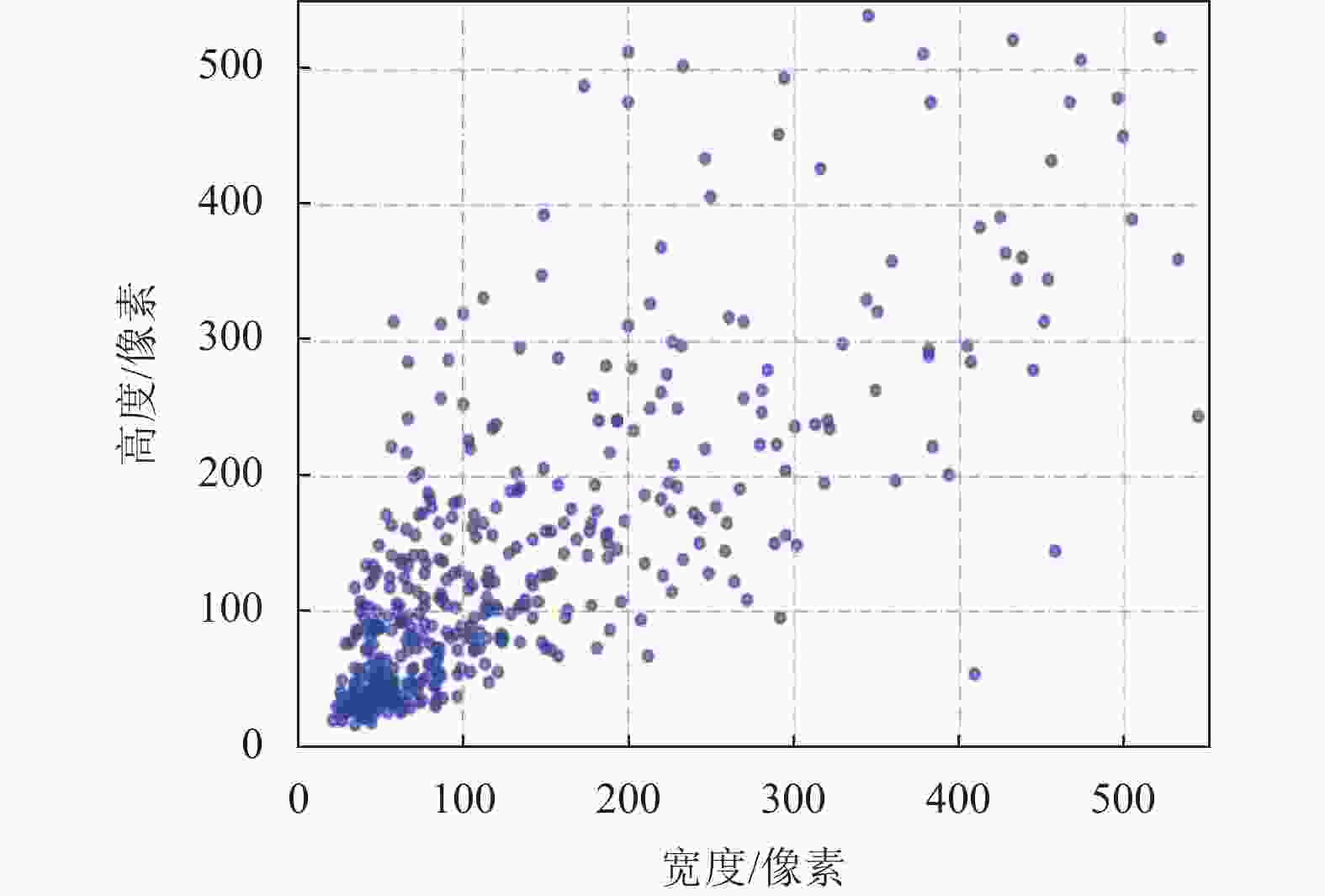

本文使用的数据集为无人机采集的输电线路图像,共有2701张。其中包括鸟巢图像1542张,挂空悬浮物图像1159张。数据集中小目标(被定义为目标边界框小于

$32 \times 32$ 像素或宽高与图像的宽高比例小于0.1的目标)较多,如图5所示。此外,数据集图像中铁塔结构和传输线路交错,有着复杂的背景,给检测小目标带来了较大的难度。所有真值框的标注均由变电站工作人员通过数月标注完成,并以XML文件的形式与无人机图像一同保存为PASCALL VOC数据集格式。所有无人机采集的输电线路图像都为高质量的PNG格式。数据集中真值框的尺寸分布如图6所示,小目标的数量大,颜色密集。据统计,小目标占比高达31%。将2701张无人机图像以8:2的比例随机制作成训练集和测试集,其中训练集和测试集分别包含2160幅和541幅图像。在实验过程中,始终保持训练集和测试集的严格分离。

-

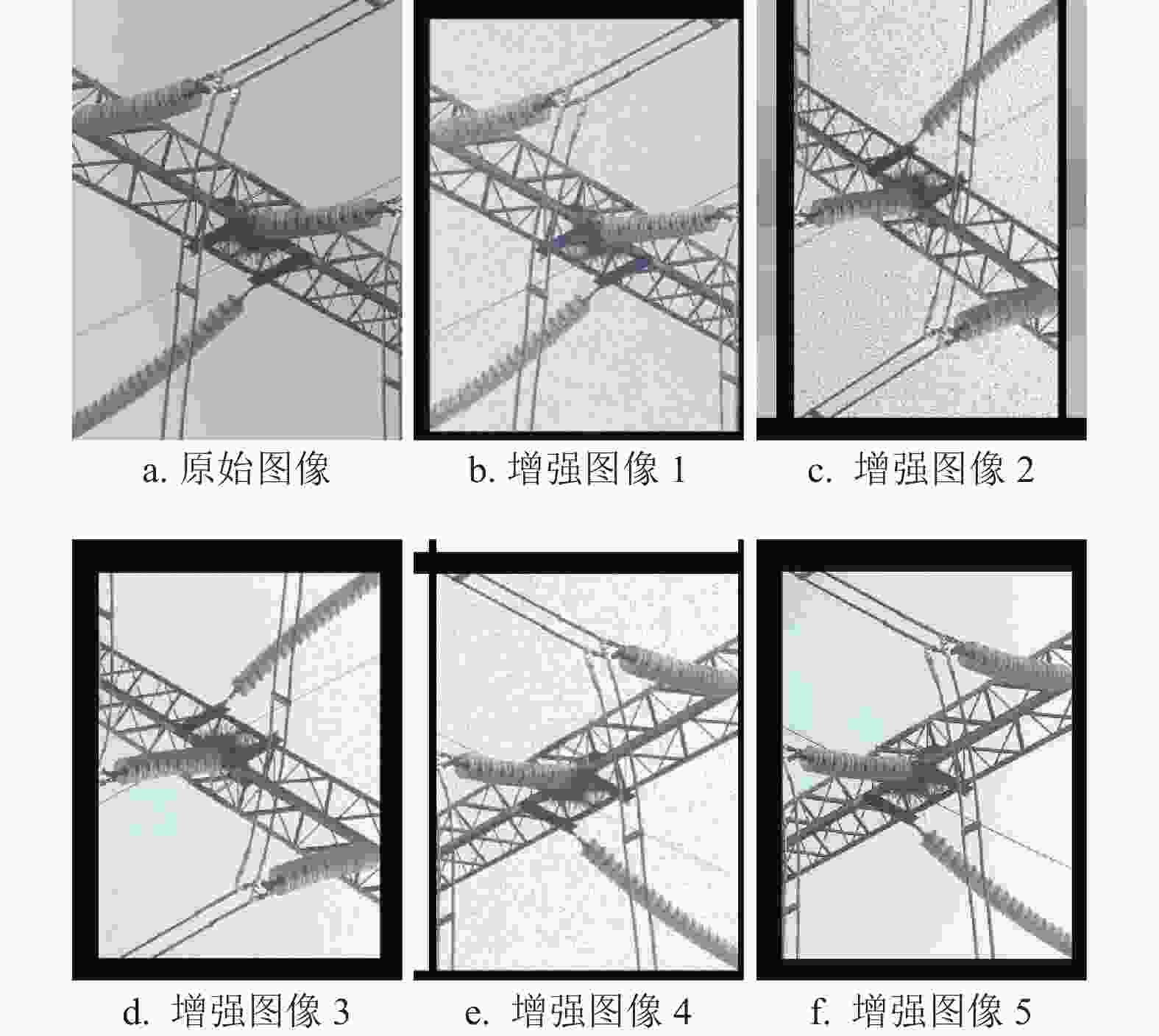

在实验中使用随机翻转、亮度变换、仿射变换、图像锐化、噪声等对原始图像进行5倍原始图像数量的数据增强,如图7所示。数据增强可以模拟不同亮度,以及无人机摄像头损坏或遭遇信号干扰等情况,从而增加网络在实际应用中的鲁棒性。

-

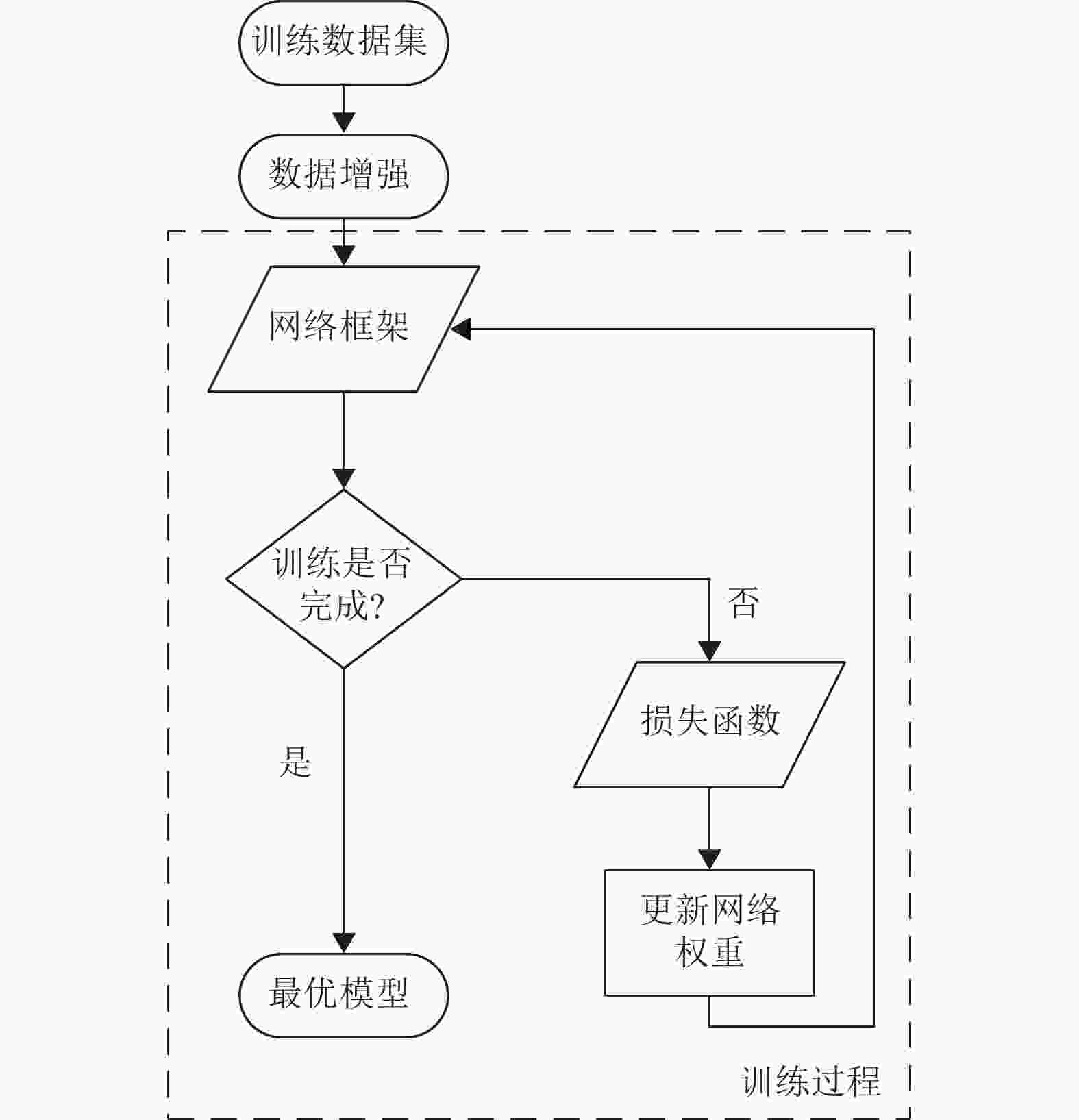

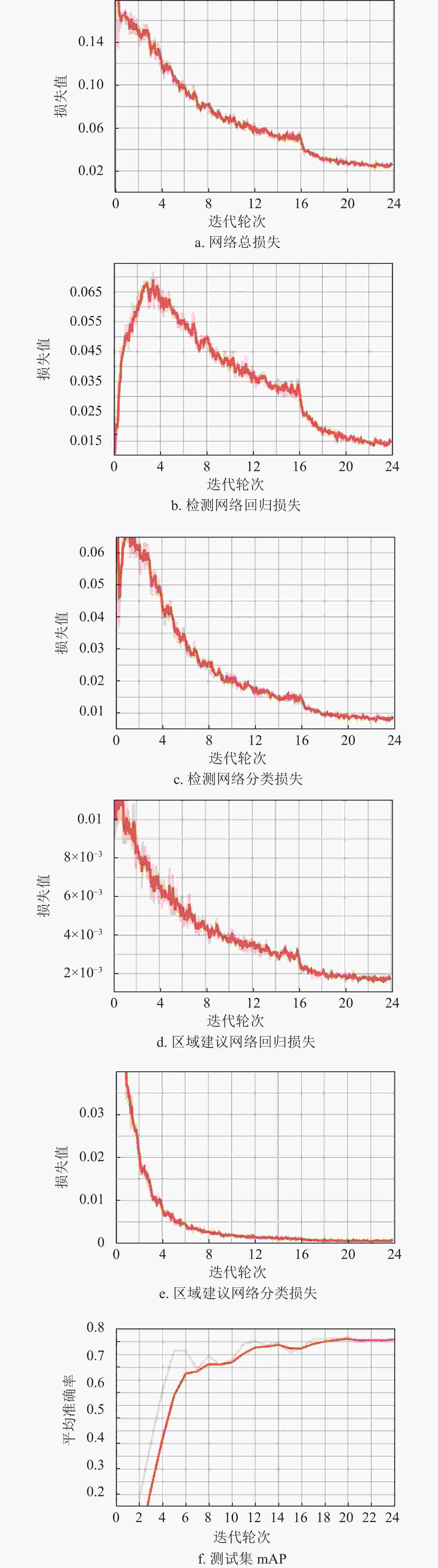

使用了在Imagenet[28]数据集上预训练的ResNet50主干网络权重,对于加入的CBAM结构使用凯明初始化。本文模型在2个GPU NVIDIA GeForce GTX 2080ti显卡上进行训练,整个网络架构进行端到端的训练。学习率预设为0.015,在前500次迭代采用学习率升温策略(warm-up),在第12个和17个迭代轮次执行学习率的衰减。批次大小为16,采用SGD梯度下降策略,动量为0.9,权重衰减为0.0001,共训练了24个epoch。训练的流程如图8所示。图9表示了训练过程中损失与测试集AP的变化,其中浅色线条为实际值曲线,深色线条为数值平滑后的变化曲线。可见在训练后期,损失和AP已经不再有大幅度的变化,实现了收敛状态。

-

除了分类的准确性,还需要对检测出的隐患的位置的准确性进行评估,因此图片分类的评估标准不再适用。平均准确率(AP)能够同时兼顾检测的准确率和召回率,是最可靠也是当前目标检测领域最常用的性能指标。AP的计算依赖于准确率和召回率的计算。

准确率(Precision)为:

$$ p = \frac{{{\rm{TP}}}}{{{\rm{TP}} + {\rm{FP}}}} $$ (8) 召回率(Recall)为:

$$ {{r}} = \frac{{{\rm{TP}}}}{{{\rm{TP}} + {\rm{FN}}}} $$ (9) 式中,TP表示成功检测到某个真值框的预测框的数量;FP表示没能匹配到某个真值框的预测框的数量;FN表示没能检测出来的真值框的数量。判断成功检测到的标准为交并比阈值,当检测框与真值框的交并比高于阈值时视为成功检测到物体。通常情况下交并比阈值设为0.5。

基于准确率和召回率的计算,AP的计算流程如下:1)网络最终输出的某一类别的检测框为N个,将N个检测框按照置信度进行排序;2)依次计算排名的前1个、前2个、···、前N个检测框的准确率和召回率;3)将准确率作为纵轴,召回率作为横轴,依次将步骤2)中计算得到的准确率和召回率连接成线,该曲线的下面积即为该类别的平均准确率。

-

将具有代表性的目标检测架构与本文模型的检测效果进行了对比,如表1所示。所有代表性的网络架构都使用了与本文模型相同的数据作为训练集和测试集,使用相同的数据增强策略。训练过程中,所有网络架构均使用了Imagenet[29]上的预训练权重初始化主干网络,经过参数的调整达到了最佳效果,以保证对比实验的有效性。

表 1 检测算法AP对比

各架构训练所得的结果均为IOU阈值为0.5时的AP检测结果。与基础 Faster R-CNN 相比,本文方法在两个类别上分别提高了约4.7%和5.9%。

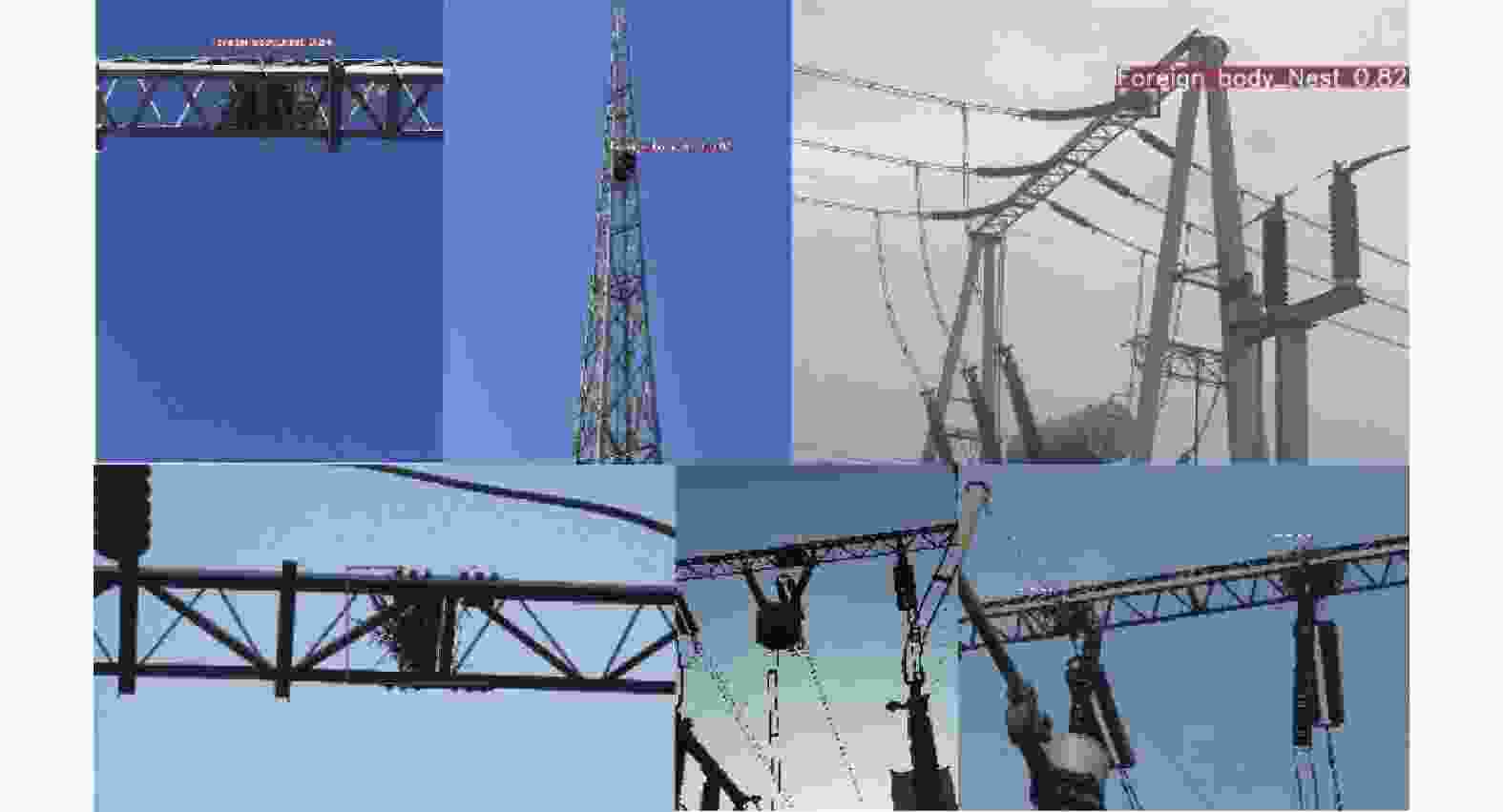

训练后的网络在部分测试集中鸟巢和挂空悬浮物上的检测效果分别如图10和图11所示。图10中大部分鸟巢(如第二、三、五、六张)为像素占比极低的小目标,网络有着较好的检测效果。图11中,部分悬浮物(如第一、三、四张)为小目标,且存在定位较难的长条形目标(如第二、五、六张)。其中第五张由于悬浮物属于长条形,其一部分也被定位为目标。但同时,网络也检测到了整体悬浮物,在实际应用中,对检测效果影响较小。此外,本文模型在复杂的背景下,如交错的铁塔和线路构造(图10中第三张,图11中第一、四张)采样图像中,模型也有可观的表现。

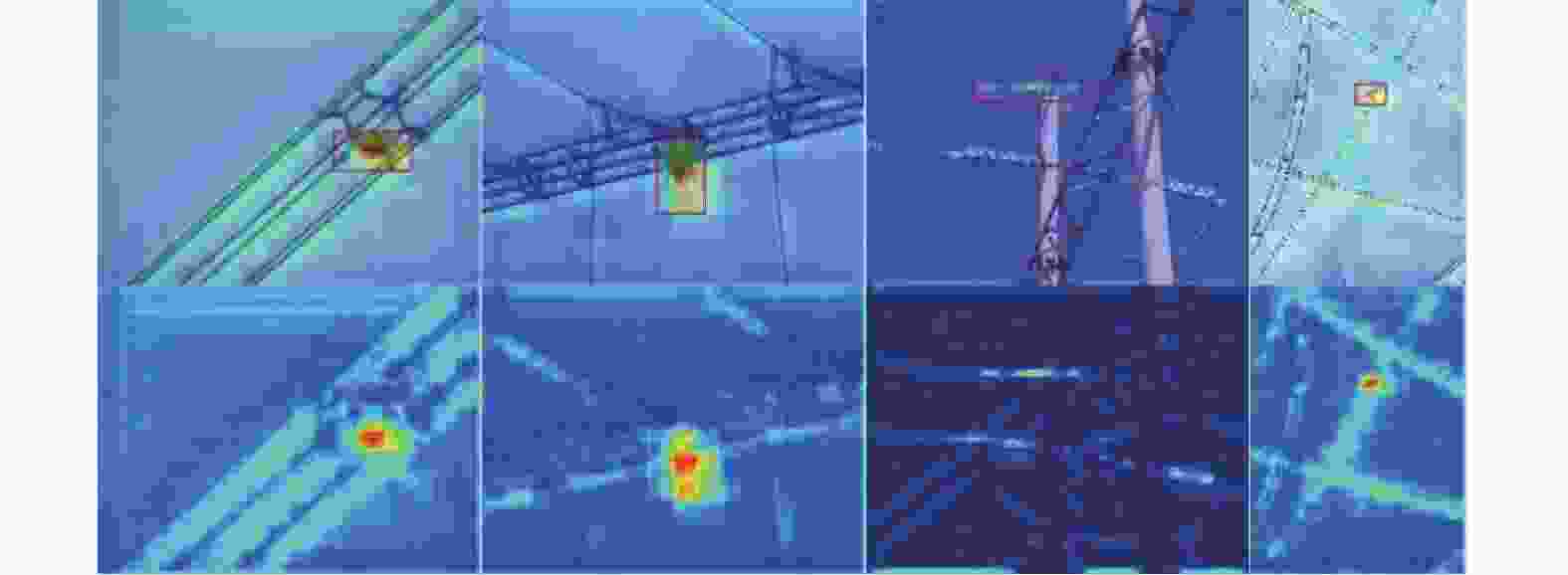

使用热力图对提出方法的可视化结果如图12所示,其中,第一行为在原图中的热力显示,第二行为网络的热力图。方框内如期望检测的目标。第一张与第二张图像为鸟巢检测,第三与第四张为悬浮物检测。可见,提出方法对输电线敏感,存在较低热度,而对鸟巢与悬浮物极为敏感,在热力图中呈现为红色。

表2中使用基准算法Faster R-CNN以及本文提出的方法对边界框小于

$32 \times 32$ 像素或宽高与图像的宽高比例小于0.1的目标进行了检测,召回率对比显示,本文方法对于小目标的召回率更高,有效减少了小目标的漏检。表 2 小目标召回率对比

算法 主干网络 召回率(鸟巢)/% 召回率(悬浮物)/% Faster R-CNN ResNet50 87.3 72.0 本文方法 ResNet-CBAM 92.6 79.7 -

本文提出了一种基于注意力机制和Soft-NMS的两阶段传输线路目标检测方法。制作了包含鸟巢和挂空悬浮物无人机图像的目标检测数据集。该方法利用了注意力机制的优势,更好地利用了图像的上下文信息。此外,采用了更适配小目标检测的后处理算法,减少了小目标的漏检。

Attention Model and Soft-NMS-Based Transmission Line Small Target Detection Method

-

摘要: 在输电线路的缺陷检测中,鸟巢以及塑料、碎布等挂空悬浮物多为小目标。其所占像素少,容易被背景干扰,检测精度有待提高。设计了一种全新的两阶段目标检测算法,用于改善对输电线路中鸟巢以及挂空悬浮物的检测效果。为了提高小目标检测的性能,在特征提取模块中融入注意力机制,以学习更为丰富的上下文信息。此外,在检测模块中,设计了基于更为柔和非极大值抑制算法的后处理方法,以减少小目标的丢失。与常用的两阶段目标检测算法相比,该方法在两个类别的平均准确率上分别提高了约4.7%和5.9%,有着更高的实际应用价值。Abstract: In the defect detection of transmission lines, the bird's nest, plastic, rags and other suspended solids are mostly small targets. They have few pixels in the images and are easy to be disturbed by the background, which make the detection accuracy needs to be improved. In this paper, a new two-stage object detection algorithm is designed to improve the detection effect of bird nests and suspended solids in transmission lines. In order to improve the detection performance of small targets, the attention mechanism is integrated into the feature extraction network to learn more rich context information. In addition, in the detection network, a post-processing method based on softer non maximum suppression algorithm is designed to reduce the loss of small targets. Compared with the commonly used two-stage object detection algorithms, the proposed method improves the average accuracy of the two categories by about 4.7% and 5.9%, respectively, and has greater value in practical applications.

-

Key words:

- attention mechanism /

- soft-NMS /

- small target detection /

- transmission line

-

表 1 检测算法AP对比

表 2 小目标召回率对比

算法 主干网络 召回率(鸟巢)/% 召回率(悬浮物)/% Faster R-CNN ResNet50 87.3 72.0 本文方法 ResNet-CBAM 92.6 79.7 -

[1] SHU Y, CHEN W. Research and application of UHV power transmission in China[J]. High Voltage, 2018, 3(1): 1-13. doi: 10.1049/hve.2018.0003 [2] PANG Y, WANG T, ANWER R M, et al. Efficient featurized image pyramid network for single shot detector[C]//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. [S.l.]: IEEE, 2019: 7336-7344. [3] YANG X, LIU Q, YAN J, et al. R3det: Refined single-stage detector with feature refinement for rotating object[EB/OL]. [2022-05-07]. https://arxiv.org/abs/1908.05612v6. [4] HU J, SHEN L, SUN G. Squeeze-and-excitation networks[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. Salt Lake City: IEEE, 2018: 7132-7141. [5] WOO S, PARK J, LEE J Y, et al. Cbam: Convolutional block attention module[C]//Proceedings of the European Conference on Computer Vision (ECCV). Berlin: Springer, 2018: 3-19. [6] HU J, SHEN L, ALBANIE S, et al. Gather-excite: Exploiting feature context in convolutional neural networks[J]. Advances in Neural Information Processing Systems, 2018, 31: 9401-9411. [7] ZhAO Z, XU G, QI Y, et al. Multi-patch deep features for power line insulator status classification from aerial images[C]//2016 International Joint Conference on Neural Networks (IJCNN). Vancouver: IEEE, 2016: 3187-3194. [8] GAO Q, WU Y, LI Q. A faulted insulator identification algorithm of sparse difference-based deep belief network[J]. Electronic Measuring Instrument, 2016, 53(1): 19-25. [9] LIU Y, YONG J, LIU L, et al. The method of insulator recognition based on deep learning[C]//2016 4th International Conference on Applied Robotics for the Power Industry (CARPI). [S.l.]: IEEE, 2016: 1-5. [10] WANG W, TIAN B, LIU Y, et al. Study on the electrical devices detection in UAV images based on region based convolutional neural networks[J]. Journal of Geo-information Science, 2017, 19(2): 256-263. [11] MA L, XU C, ZUO G, et al. Detection method of insulator based on faster R-CNN[C]//2017 IEEE 7th Annual International Conference on CYBER Technology in Automation, Control, and Intelligent Systems (CYBER). Honolulu: IEEE, 2017: 1410-1414. [12] QING C, BIN Y, RUN Y, et al. Insulator detection and recognition of explosion fault based on convolutional neural networks[J]. Journal of Electronic Measurement and Instrument, 2017, 31(6): 942-953. [13] REN S, HE K, GIRSHICK R, et al. Faster R-CNN: Towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6): 1137-1149. doi: 10.1109/TPAMI.2016.2577031 [14] ZHOU Z, YUAN G, FENG W, et al. Target recognition and evaluation of typical transmission line equipment based on deep learning[C]//Proceedings of Purple Mountain Forum 2019-International Forum on Smart Grid Protection and Control. Singapore: Springer, 2020: 701-709. [15] GAO F, WANG J, KONG Z, et al. Recognition of insulator explosion based on deep learning[C]//2017 14th International Computer Conference on Wavelet Active Media Technology and Information Processing (ICCWAMTIP). Chengdu: IEEE, 2017: 79-82. [16] BAI R X, CAO H, YU Y J, et al. Insulator fault recognition based on spatial pyramid pooling networks with transfer learning (match 2018)[C]//2018 3rd International Conference on Advanced Robotics and Mechatronics (ICARM). Beijing: IEEE, 2018: 824-828. [17] LIU X, JIANG H, CHEN J, et al. Insulator detection in aerial images based on faster regions with convolutional neural network[C]//2018 IEEE 14th International Conference on Control and Automation (ICCA). [S.l.]: IEEE, 2018: 1082-1086. [18] WANG Y, WANG J, GAO F, et al. Detection and recognition for fault insulator based on deep learning[C]//2018 11th International Congress on Image and Signal Processing, BioMedical Engineering and Informatics (CISP-BMEI). Beijing: IEEE, 2018: 1-6. [19] LING Z, QIU R C, JIN Z, et al. An accurate and real-time self-blast glass insulator location method based on faster R-CNN and U-net with aerial images[EB/OL]. [2022-6-11]. https://arxiv.org/pdf/1801.05143.pdf. [20] WANG B, WU R, ZHENG Z, et al. Study on the method of transmission line foreign body detection based on deep learning[C]//2017 IEEE Conference on Energy Internet and Energy System Integration (EI2). [S.l.]: IEEE, 2017: 1-5. [21] TIAN B, LI D, WANG W, et al. Transmission line image defect diagnosis preprocessed parallel method based on deep learning[C]//2018 3rd International Conference on Mechanical, Control and Computer Engineering (ICMCCE). [S.l.]: IEEE, 2018: 299-303. [22] OHTA H, SATO Y, MORI T, et al. Image acquisition of power line transmission towers using uav and deep learning technique for insulators localization and recognition[C]//2019 23rd International Conference on System Theory, Control and Computing (ICSTCC). [S.l.]: IEEE, 2019: 125-130. [23] CHEN H, HE Z, SHI B, et al. Research on recognition method of electrical components based on YOLO V3[J]. IEEE Access, 2019, 7: 157818-157829. doi: 10.1109/ACCESS.2019.2950053 [24] LIU S, WANG B, GAO K, et al. Object detection method for aerial inspection image based on region-based fully convolutional network[J]. Automation of Electric Power Systems, 2019, 43(13): 162-168. [25] 李弘宸, 杨忠, 姜遇红, 等. 基于优化ResNet的输电线路航拍图像分类方法[J]. 应用科技, 2021, 48(2): 64-68. doi: 10.11991/yykj.202007009 LI H C, YANG Z, JIANG Y H, et al. Aerial image classification method of transmission lines based on optimized ResNet[J]. Applied Science and Technology, 2021, 48(2): 64-68. doi: 10.11991/yykj.202007009 [26] IOFFE S, SZEGEDY C. Batch normalization: Accelerating deep network training by reducing internal covariate shift[C]//International Conference on Machine Learning. [S.l.]: PMLR, 2015: 448-456. [27] APICELLA A, DONNARUMMA F, ISGRO F, et al. A survey on modern trainable activation functions[J]. Neural Networks, 2021, 138: 14-32. doi: 10.1016/j.neunet.2021.01.026 [28] BODLA N, SINGH B, CHELLAPPA R, et al. Soft-NMS--improving object detection with one line of code[C]//Proceedings of the IEEE International Conference on Computer Vision. [S. l.]: IEEE, 2017: 5561-5569. [29] DENG J, DONG W, SOCHER R, et al. Imagenet: A large-scale hierarchical image database[C]//2009 IEEE Conference on Computer Vision and Pattern Recognition. [S. l.]: IEEE, 2009: 248-255. [30] CAI Z, VASCONCELOS N. Cascade R-CNN: Delving into high quality object detection[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. [S. l.]: IEEE, 2018: 6154-6162. [31] REDMON J, FARHADI A. Yolov3: An incremental improvement[EB/OL]. [2022-7-11]. https://arxiv.org/pdf/1804.02767.pdf. [32] BOCHKOVSKIY A, WANG C Y, LIAO H Y M. Yolov4: Optimal speed and accuracy of object detection[EB/OL]. [2022-7-15]. https://arxiv.org/abs/2004.10934 -

ISSN

ISSN

下载:

下载: