-

自20世纪60年代以来,遥感技术便迅猛发展,如今广泛应用于军事监测、环境监测、地质勘探和空间观测等众多领域,成为了一项不可或缺的技术[1-3]。遥感光谱在很大程度上能够表征地物的特征,高光谱遥感图像更是蕴含着大量的光谱信息,对勘测和识别分析地物等具有重大意义[1]。然而由于高光谱图像的空间分辨率较低,丧失了很多有用的空间信息。因此,如何提高高光谱图像的空间分辨率成为遥感领域的热点和难点问题。

相较于高光谱图像,多光谱图像具有高空间分辨率、低光谱分辨率的特点。因此,可以融合低空间分辨率的高光谱图像和高空间分辨率的多光谱图像,从而得到高空间分辨率的高光谱图像[4]。在过去的几十年中,用于多光谱或高光谱图像(多波段图像)和全色图像(单波段图像)的融合算法,被扩展到高光谱和多光谱图像(多波段和多波段图像)融合应用中,且有不同的算法[5-8]被提出。以上算法都得到较好的融合结果,但这些算法都使用了退化模型,退化模型体现了传感器的特性[9]。在遥感探测实际应用中,不能始终完全得到退化模型,所以算法仍需改善。

近年来,基于字典的融合方法成为遥感领域一个新的研究热点。文献[10]提出了一种基于字典学习的端元矩阵提取和基于稀疏编码的矩阵提取的方法。文献[11]将稀疏表示(sparse representation, SR)算法和协同表示算法结合起来,但未应用于高光谱和多光谱的融合中。文献[12]和文献[13]算法用于解决多光谱或高光谱和全色图像的融合问题,取得了较好的融合结果。文献[14]将J-Sparse算法推广到高光谱和多光谱图像融合,文献[15]提出J-SparseFI算法优化J-Sparse算法的问题。但文献[14]的方法使用全局字典和稀疏表示技术,字典对规模较为庞大,从而导致相对较高的计算复杂度。

针对以上问题,本文提出一种使用局部自适应字典对和协同表示技术的图像融合(LACRF)算法,用于在尽可能保留丰富光谱信息的前提下,增强高光谱图像的空间分辨率。首先,提出一种新的基于Pan-sharpening的高光谱和多光谱图像融合框架。该框架根据多光谱图像的光谱特征,将高光谱图像的光谱波段分为互相独立且互不重叠的几个光谱区间,把高光谱和多光谱图像融合问题简化为多个多波段和单波段图像融合问题。然后,在多波段和单波段图像融合中,LACRF算法使用基于局部自适应字典的图像融合算法和协同表示技术。在高空间分辨率图像重构中,协同表示技术根据字典中原子的有效性,分配给不同原子不同的权值。在得到一系列的高空间分辨率的多波段图像后,完成高光谱和多光谱图像的融合。最后通过实验得出,LACRF算法以及框架相比于使用全局字典和稀疏表示(fusion algorithm based on sparse representation using global dictionary, GCSF)的算法和使用全局字典和协同表示(fusion algorithm based on collaborative representation using global dictionary, GCRF)的算法更加有效,能得到更好的融合结果。

HTML

-

基于传统Pan-sharpening技术,本文提出基于协同表示的高光谱和多光谱图像融合方法。

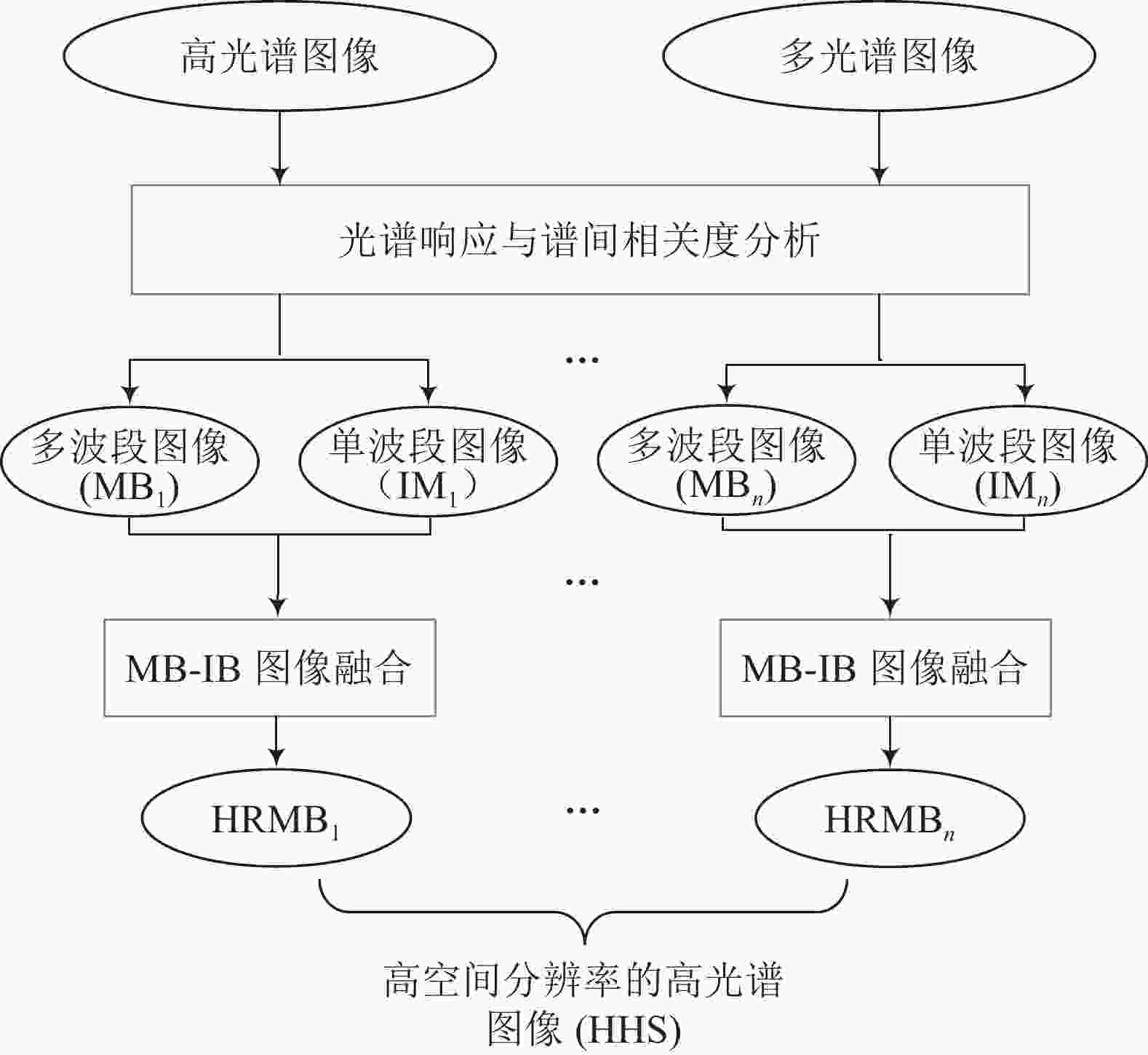

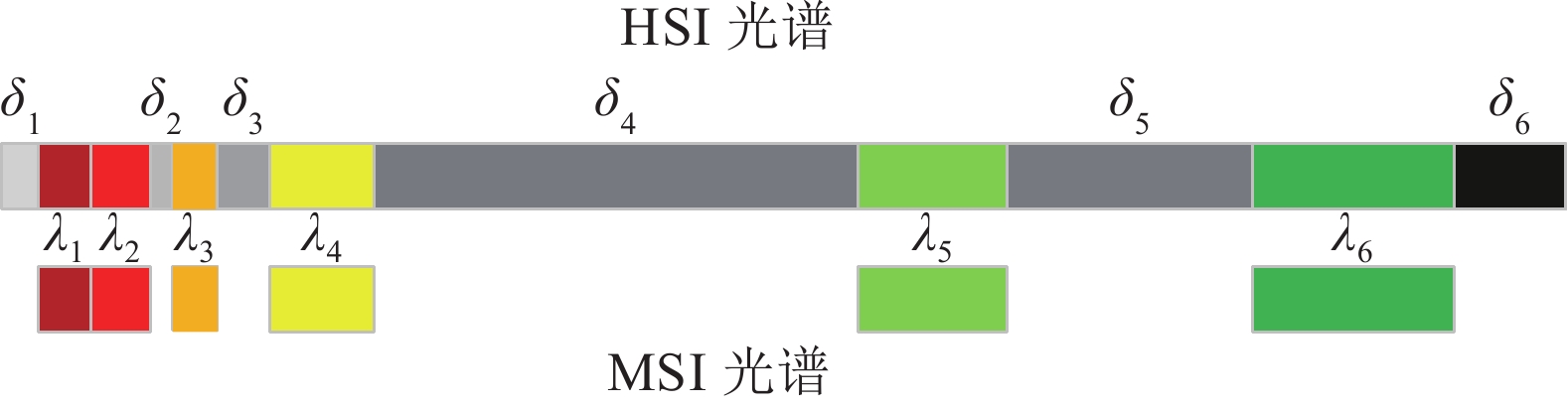

首先,提出一种新的高光谱和多光谱图像融合框架,如图1所示。依据高光谱图像波谱和多光谱图像波谱响应和谱间相关度,高光谱图像的整个波谱被分为若干区间。同时高光谱和多光谱(HS-MS)图像的融合问题被简化为若干个多波段−单波段(MB-IB)图像融合问题。

其次,对于每一个多波段−单波段图像融合问题,提出了基于协同表示的LACRF融合算法,得到高空间分辨率的多波段(HRMB)图像。对于高光谱图像存在一些无法被多光谱图像波谱覆盖的波段空间分辨率提高的难题,本文提出基于光谱邻域的光谱重采样技术来解决这一问题。在得到若干个高空间分辨率的多波段图像后,最终得到高空间分辨率的高光谱图像(HHS)。

-

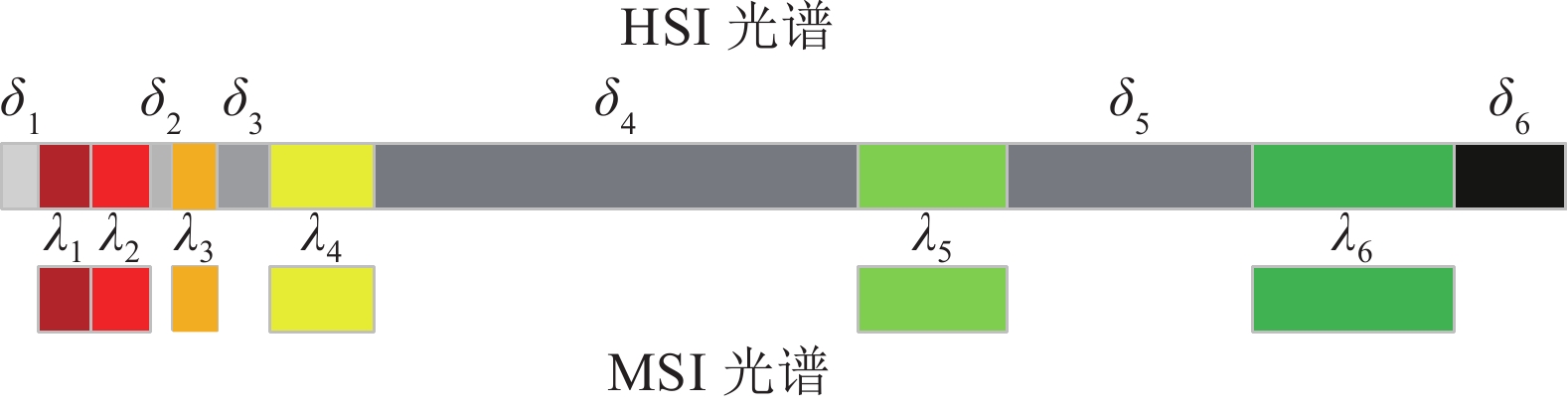

对于同一场景观测得到的高光谱图像(hyperspectral image, HSI)和多光谱图像(multispectral image, MSI),高光谱图像的光谱波段是连续的,多光谱图像的光谱波段存在局部间断的情况。设高光谱图像有P个波段,多光谱图像有Q个波段,且

$P > Q$ ,如图2所示。根据多光谱−高光谱图像的光谱相应关系,高光谱图像的P个波段被分割为K个区间${\lambda _k}(k = 1,2, \cdots ,K)$ ,则高光谱图像在光谱区间${\lambda _k}$ 的波段数为${P_k}$ 。每一个高光谱图像光谱分区实际上是一个多波段图像,共有K个多波段图像。通过分区,高光谱和多光谱图像融合被简化为K个多波段图像的空间分辨率提高问题。

-

为了解决多波段图像的空间分辨率增强问题,提出一种基于协同表示技术,使用局部自适应字典对的算法(LACRF)。

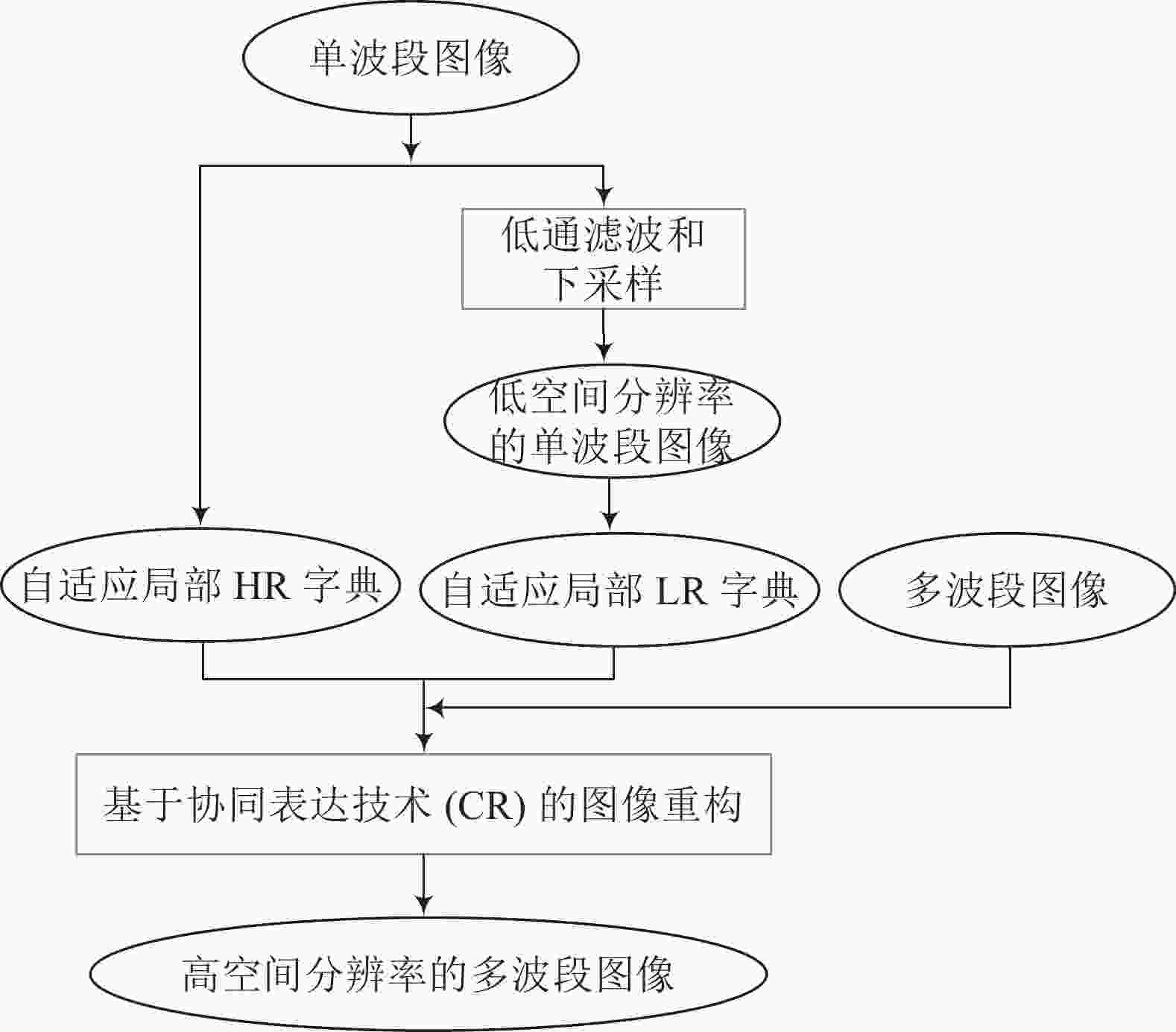

LACRF算法包含3部分:1)字典构建;2)系数向量估计;3)高空间分辨率的多波段图像。其框架如图3所示。

-

根据第2节的高光谱波谱分割方法,首先考虑存在对应多光谱波段光谱覆盖的Q个分区

${\lambda _q}(q = 1,2, \cdots ,Q)$ 对应的多波段图像的空间分辨率提高问题。设Y为一个${\lambda _q}$ 多波段图像,它和对应的多光谱图像的波段X0进行融合。高光谱和多光谱图像融合算法框架和LACRF算法,只需要知道空间退化模型。使用空间退化模型,X0通过低通滤波和下采样得到X0的低空间分辨率版本记为

$X_0^{\rm{L}}$ 。$X_0^{\rm{L}}$ 和Y被空间分割为M个不重叠的子块。对于Y中任意给定的低空间分辨率(low resolution, LR)子块$x$ ,在$X_0^{\rm{L}}$ 中$x$ 对应位置子块周围的M个LR邻域子块作为$x$ 低空间分辨率字典。将这M个邻域LR子块拉伸列向量,则给定子块$x$ 的LR字典可以表示为:式中,

${{d}}_i^{\rm{L}}(i = 1,2, \cdots ,M)$ 为M个LR子块的拉伸而成的列向量,每一个列向量为LR字典${D^{\rm{L}}}$ 中的原子。类似地,高空间分辨率的X0被分割为M个不交叠的高空间分辨率(high resolution, HR)的子块,X0中的子块的空间分辨率是

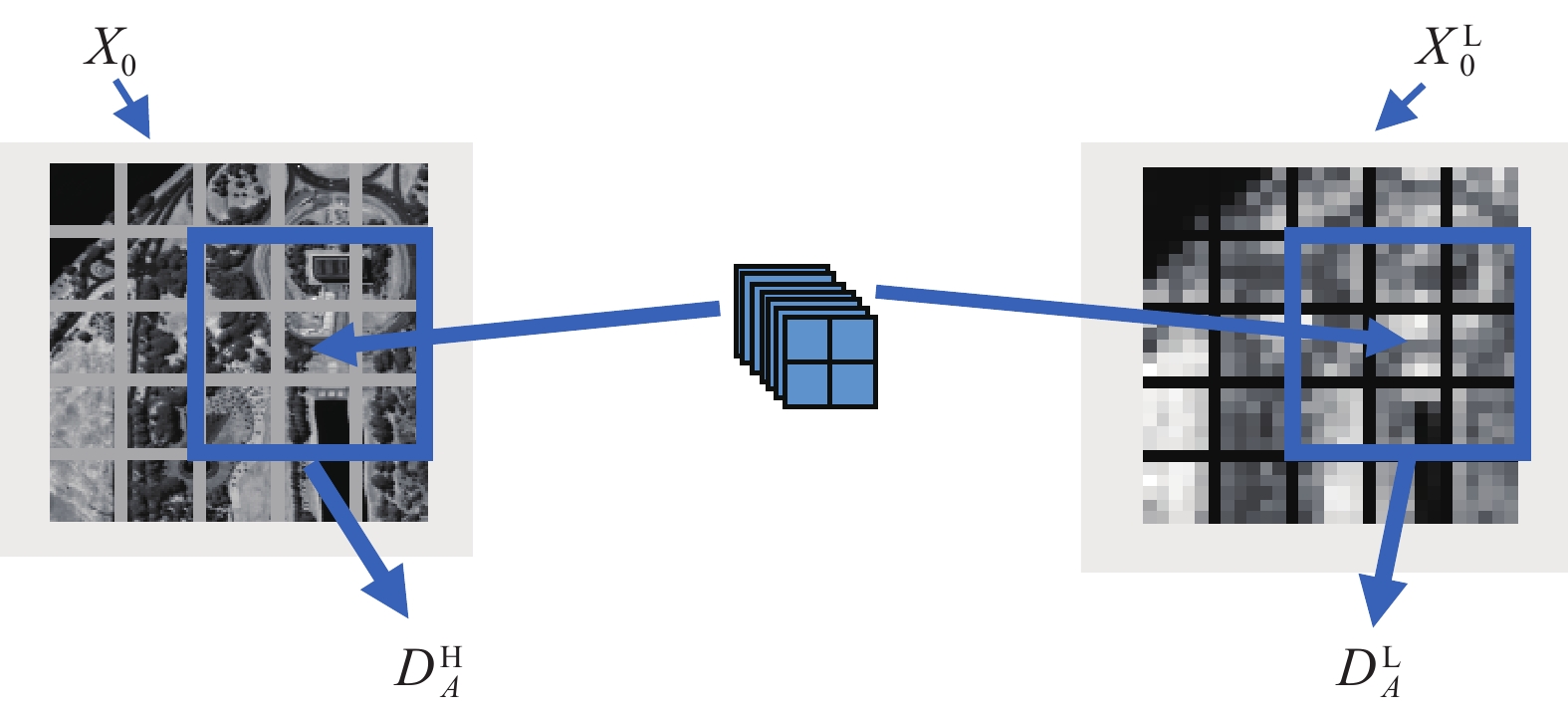

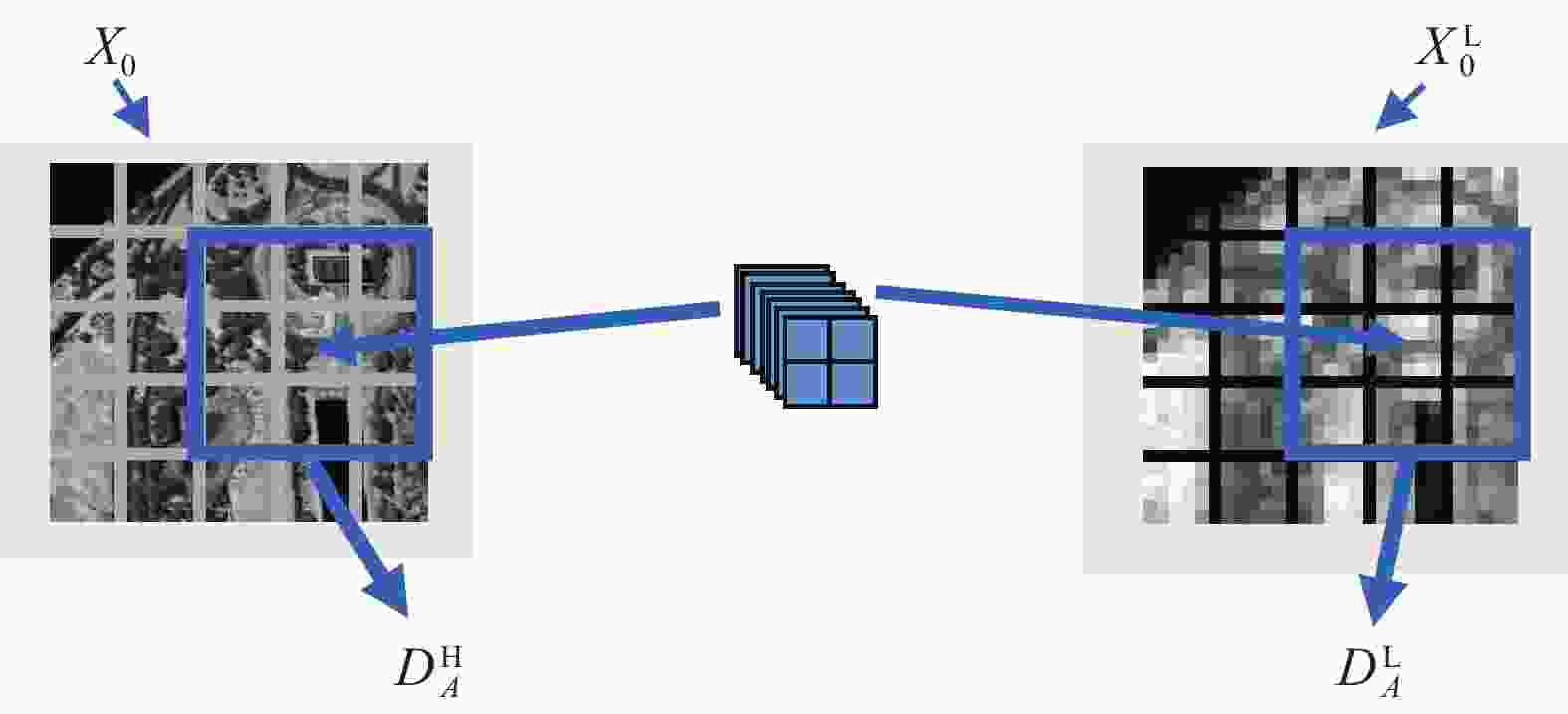

$X_0^{\rm{L}}$ 中LR子块空间分辨率的$\omega $ 倍。需要注意的是X0中M个子块在X0的相对位置和$X_0^{\rm{L}}$ 中M个子块在$X_0^{\rm{L}}$ 中的相对位置是一致的。同理,可以得到给定子块$x$ 的高空间分辨率字典:自适应局部字典构建示意图如图4所示,A为Y中给定多波段子块,X0为单波段图像,

$X_0^{\rm{L}}$ 为X0的低空间分辨率版本,$D_A^{\rm{L}}$ 和$D_A^{\rm{H}}$ 分别为A的LR字典和HR字典。把图像分成若干个子块,在处理子块A时,会针对A构建一个字典。因此,每个子块的字典都是不同的。随着多波段子块A的变化,其字典对也会变化,体现了自适应性。

在构建字典时,采用当前正在处理图像块周边若干个临近的部分子块来构建字典,没有选用全部的图像块,这体现了字典的局部性,不是全局的,减小了字典的规模,降低了计算复杂度。

-

设

${{ y}_b}$ 是Y中每一多波段子块y的第b个波段,子块y的HR字典和LR字典可以训练得到${{ D}^{\rm{H}}}$ 和${{ D}^{\rm{L}}}$ 。${{ y}_b}$ 可以由${{ D}^{\rm{L}}}$ 中原子的线性组合得到:使用式(3),利用协同表示技术,系数向量

${{ \alpha} _b}$ 估计为:其中

${{\varGamma}} $ 是偏置Tikhonov矩阵,表示为:另外,

$\eta $ 为全局规则化参数,用于平衡式(4)中的规则化项$\left\| {{{\varGamma}} {{ \alpha} _b}} \right\|_2^2$ 和$\left\| {{D^{\rm{L}}}{{ \alpha} _b} - {{ y}_b}} \right\|_2^2$ 项。${{ \alpha} _b}$ 的最优化估计值为: -

设Z为多波段图像Y和单波段图像X0融合结果得到的高空间分辨率的高光谱图像。

${{ z}_b}$ 为Z中多波段子块的第b个波段。假设${{ z}_b}$ 在字典${{ D}^{\rm{H}}}$ 空间下的系数和${{ y}_b}$ 在字典${{ D}^{\rm{L}}}$ 空间的系数一样。已知${{ y}_b}$ 在字典${{ D}^L}$ 空间的系数估计值为${\hat { \alpha} _b}$ ,则:对于所有的

${{ z}_b}$ 进行空间排列叠加,最终得到高空间分辨率的多波段图像Z。

3.1. 自适应局部字典的构建

3.2. 系数估计与其数据特征

3.3. 高空间分辨率多波段图像重构

-

模拟实验将在从实际的高光谱源图像得到的两个合成数据上进行。这些实际的高光谱数据将和最终的融合结果进行比较,评判算法融合性能。第一个实验数据是1996年从AVIRIS上得到的Indian Pines 数据,共224个波段,光谱区间在400~2 500 nm之间。第二个实验数据是来自于HYDICE的Washington DC,共191个波段,波谱范围400~2 500 nm之间。为了计算方便,实验数据的每一个波段的数据规模只选取

$120 \times 120$ 个像素。低空间分辨率的高光谱图像由实际的源图像高斯采样得到,采样率为6。高空间分辨率的多光谱图像由实际的源图像光谱退化得到,光谱退化的依据是Landsat卫星TM传感器1−5波段和第7波段的光谱特性,这6个波段区间的光谱范围是:450~520 nm,520~600 nm,630~690 nm,760~900 nm,1 550~1 750 nm和2 080~2 350 nm。另外,高斯噪声被加到模拟的低空间分辨率高光谱图像和高空间分辨率的多光谱图像上,模拟的多光谱传感器的信噪比为200,模拟的高光谱传感器的信噪比为300。

-

对高光谱和多光谱图像融合结果的评价重点放在光谱失真和空间信息的提高这两个方面。

设

$\hat Z$ 为融合结果,$Z$ 为高空间分辨率高光谱的源图像,评价指标如下:1) 峰值信噪比

图像峰值信噪比(peak signal-to-noise ratio, PSNR)定义如下:

式中,

${\rm{Ma}}{{\rm{x}}_i}$ 是第$i$ 波$i$ 段中最大像元值;${n_m}$ 是像素的总数;${L_h}$ 是波段数。PSNR值越大,说明融合结果引入的噪声越小,图像融合的效果越好。2) 光谱角制图

光谱角制图(spectral angle mapper, SAM)定义如下:

式中,

${\hat {{Z}}_{:,j}}$ 是融合图像第$j$ 个像素的光谱向量;${{{Z}}_{:,j}}$ 是源图像的光谱向量。SAM表征的是光谱重构质量,取值0~1,理想情况下,SAM的值为1,即不存在光谱失真。 -

为了验证所提出算法的有效性,本实验设计了两种与LACRF算法相似的GCSF和GCRF算法进行对比试验。在GCSF算法中,使用全局字典以及稀疏表示方法,得到高空间分辨率的高光谱图像。在GCRF算法中,使用了全局字典和协同表示技术,得到高空间分辨率的高光谱图像。与上述两种算法对比,能够有效地度量LACRF算法所采用的协同表示和局部自适应字典方法的效果。

在LACRF算法进行局部自适应字典训练时,邻域子块选取范围

$3 \times 3$ ,共9个子块。GCSF算法中,稀疏表示中的规则化参数为0.046,在使用协同表示的两个算法中,规则化参数设为0.04。参数的选取依据是使最终融合结果的PSNR最优。单个子块的规模由单波段图像X0中高空间分辨率子块的规模确定。表1为3种算法在不同子块规模下的评价指标值,是针对Indian Pine数据的实验结果。对于两个实验数据,GCSF和GCRF算法融合结果的PSNR随着子块规模的增大而不断增大,SAM则不断减小,这意味着随着子块规模的增大,融合结果质量不断改善,在

$60 \times 60$ 处达到最优。而LACRF算法融合结果的PSNR在$6 \times 6$ 到$30 \times 30$ 之间随着子块规模的增大而增大,在$30 \times 30$ 达到峰值,随后减小;相应SAM与PSNR随着子块规模变化趋势相反,先不断减小,到达谷底后再增加。因此对于两个实验数据,LACRF算法在$30 \times 30$ 的子块规模下融合结果性能最优。比较Indian Pine数据下,不同子块规模LACRF的最优解是PSNR=36.66、SAM=1.23($30 \times 30$ ),GCSF算法的最优解是PSNR=36.37、SAM=1.34($60 \times 60$ ),GCRF算法的最优解是PSNR=36.33、SAM=1.35($60 \times 60$ )。子块规模 LACRF GCSF GCRF PSNR SAM PSNR SAM PSNR SAM 6×6 24.77 4.02 21.83 5.61 23.32 5.39 24×24 36.29 1.29 35.89 1.27 32.34 1.87 30×30 36.66 1.23 35.10 1.61 35.50 1.53 60×60 36.33 1.35 36.37 1.34 36.33 1.35 表2为Washington DC数据的实验结果。针对Washington DC数据,不同子块规模LACRF的最优解是PSNR=37.69、SAM=1.64(

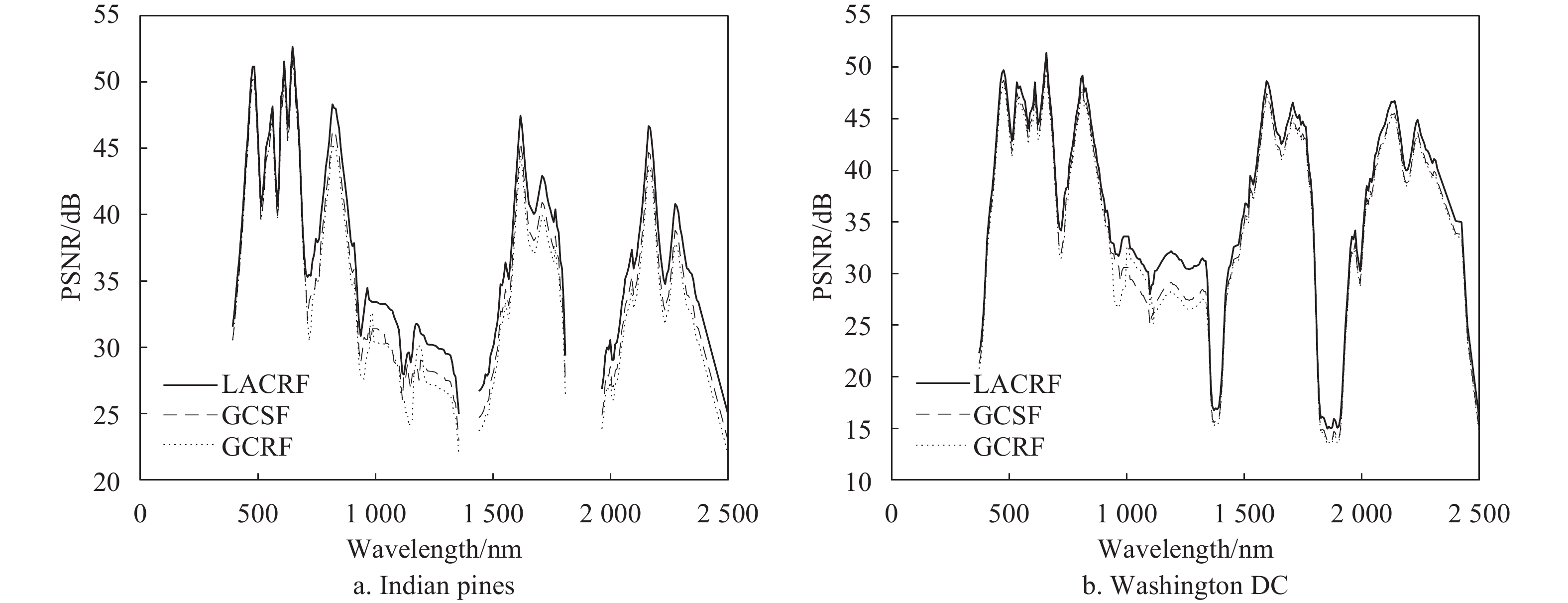

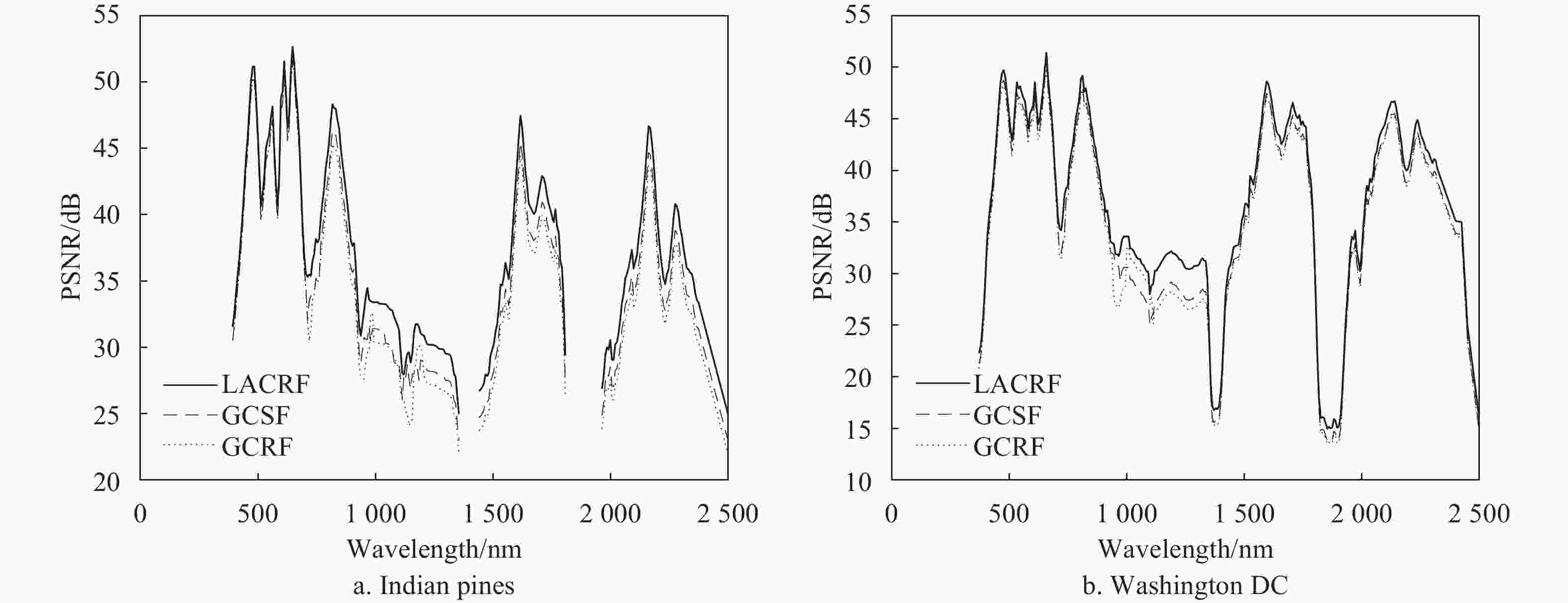

$30 \times 30$ ),GCSF算法的最优解是PSNR=37.15、SAM=1.89($60 \times 60$ ),GCRF算法的最优解是PSNR=37.13、SAM=1.90($60 \times 60$ )。比较Indian Pines和Washington DC两个实验数据下,3种算法的最优解,可知LACRF算法的实验结果优于另外两种算法。子块规模 LACRF GCSF GCRF PSNR SAM PSNR SAM PSNR SAM 6×6 21.11 9.88 18.22 12.81 19.47 12.35 24×24 27.84 4.78 20.97 8.76 23.36 6.79 30×30 36.84 1.83 34.57 2.24 31.81 3.48 60×60 37.69 1.64 35.98 2.11 36.30 1.99 图5是在高光谱波谱下PSNR值,表征了3种算法在不同波段的性能。对于Indian Pines数据,LACRF算法在整个波谱范围内PSNR值都大于GCSF算法和GCRF算法。尤其在900~1 200 nm范围内,LACRF算法相比于另外两种算法优势更加明显。对于Washington DC数据,在整个波谱范围,LACRF算法的PSNR值都要高于另外两种算法,在950~1 300 nm范围内优势最为明显。

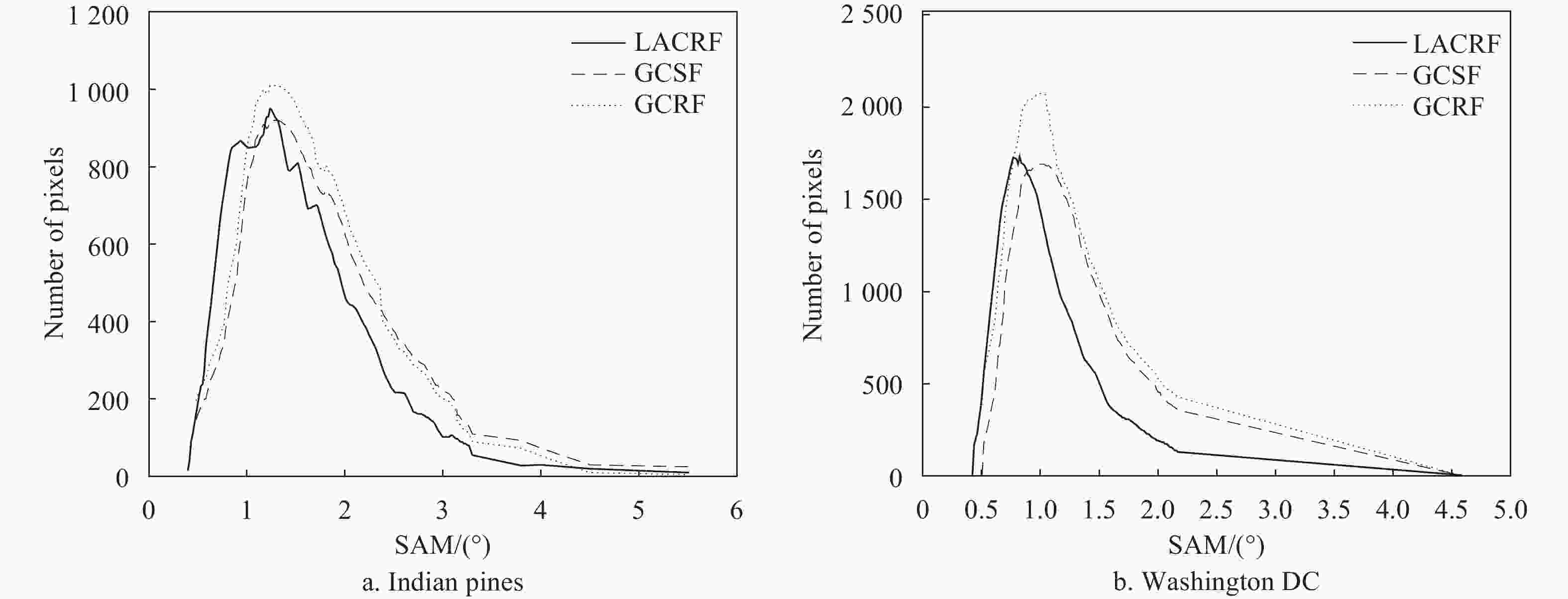

图6是光谱角制图SAM的直方图,由直方图可知LACRF算法的SAM的平均值更小。

综合表格数据和仿真图可知,将高光谱和多光谱图像融合简化为若干个多波段图像空间分辨率增强算法框架,LACRF算法具有有效性,且相比GCRF和GCSF算法更具优越性。

4.1. 实验数据

4.2. 评估指标

4.3. 实验结果与分析

-

根据多光谱图像和高光谱图像的光谱响应和谱间特征,提出高光谱和多光谱图像融合框架,将高光谱和多光谱图像融合问题简化为若干个多波段图像的空间分辨率增强问题。并在此基础上提出一种基于协同表示技术、使用局部自适应字典和协同表示技术的多波段图像空间分辨率增强LACRF算法。通过和相似的两种算法GCRF和GCSF比较,表明LACRF算法不仅字典训练更为简单有效,字典规模更小,并且能得到更好的融合结果。

ISSN

ISSN

DownLoad:

DownLoad: